大数据入门——HDFS新增节点

服役新数据节点

===========================================================================

准备工作(九步)

目标:掌握HDFS新添加节点到集群的步骤

准备新节点

第一步:复制一台新的虚拟机出来

将我们纯净的虚拟机复制一台出来,作为我们新的节点

第二步:修改mac地址以及IP地址

修改mac地址命令

vim /etc/udev/rules.d/70-persistent-net.rules

修改ip地址命令

vim /etc/sysconfig/network-scripts/ifcfg-eth0

第三步:关闭防火墙,关闭selinux

关闭防火墙

service iptables stop

关闭selinux

vim /etc/selinux/config

第四步:更改主机名

更改主机名命令

vim /etc/sysconfig/network

第五步:四台机器更改主机名与IP地址映射

四台机器都要添加hosts文件

vim /etc/hosts

第六步:node04服务器关机重启并生成公钥与私钥

node04执行以下命令生成公钥与私钥

ssh-keygen -t rsa

node04执行以下命令将node04的私钥拷贝到node01服务器

ssh-copy-id node01

node01执行以下命令,将authorized_keys拷贝给node04

cd /root/.ssh/

scp authorized_keys node04:$PWD

第七步:node04安装jdk

第八步:解压Hadoop安装包

在node04服务器上面解压Hadoop安装包到/export/servers

node01执行以下命令将Hadoop安装包拷贝到node04服务器

cd /export/softwares/

scp hadoop-2.6.0-cdh5.14.0-自己编译后的版本.tar.gz node04:$PWD

第九步:将node01关于Hadoop的配置文件全部拷贝到node04

node01执行以下命令,将Hadoop的配置文件全部拷贝到node04服务器上面

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/

scp ./ node04:$PWD*

============================================================

服役新节点具体步骤

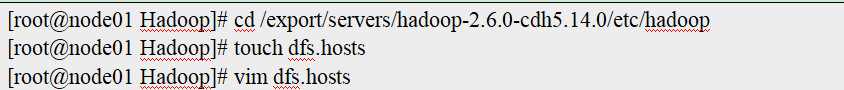

第一步:创建dfs.hosts文件(HDFS可用的白名单)

在node01也就是namenode所在的机器的/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop目录下创建dfs.hosts文件

添加如下主机名称(包含新服役的节点)

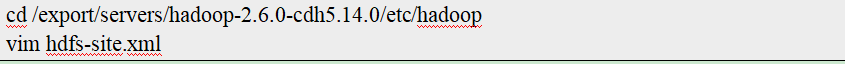

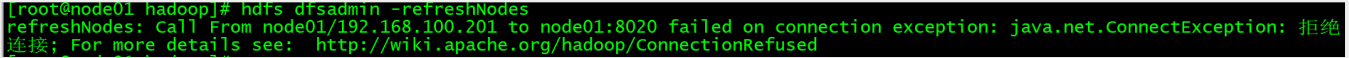

第二步:node01编辑hdfs-site.xml添加以下配置

在namenode的hdfs-site.xml配置文件中增加dfs.hosts属性

node01执行以下命令

在hdfs-site.xml中添加dfs.hosts属性

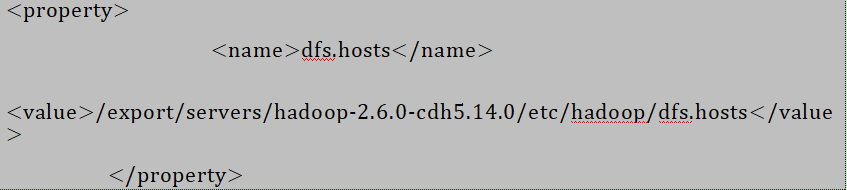

第三步:刷新namenode

node01执行以下命令刷新namenode

[root@node01 Hadoop]# hdfs dfsadmin -refreshNodes

如果响应这句话

Refresh nodes successful

就代表刷新成功了

如果响应这个

可能是你没开启集群

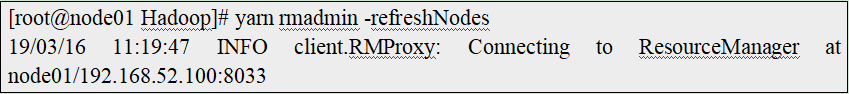

第四步:更新resourceManager节点

node01执行以下命令刷新resourceManager

命令:yarn rmadmin -refreshNodes

第五步:namenode的slaves文件增加新服务节点主机名称

node01编辑slaves文件,并添加新增节点的主机,更改完后,slaves文件不需要分发到其他机器上面去

node01执行以下命令编辑slaves文件

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim slaves

添加信息如下:

node01

node02

node03

node04

第六步:单独启动新增节点

node04服务器执行以下命令,启动datanode和nodemanager

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/hadoop-daemon.sh start datanode

sbin/yarn-daemon.sh start nodemanager

第七步:浏览器查看

http://node01:50070/dfshealth.html#tab-overview

http://node01:8088/cluster

第八步:使用负载均衡命令,让数据均匀负载所有机器

node01执行以下命令

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/start-balancer.sh

课堂总结:

新节点添加到集群

1.在主节点 创建dfs.hosts(HDFS可用白名单)

在dfs.hosts添加所有的主机

2.修改hdfs-site.xml添加如下配置

dfs.hosts

/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/dfs.hosts

3.刷新namenode

HDFS:hdfs dfsadmim -refreshNodes

YARN: yarn rmadmin -refreshNodes

4 添加 新节点到slave

node01

node02

node03

node04

slave 文件中记录的节点在集群启动时会进行启动。

5 启动新节点上的服务

sbin/hadoop-daemon.sh start datanode

sbin/yarn-daemon.sh start nodemanager

6 查看HDFS YARN 界面

7 负载均衡

./ start-balancer.sh

- 点赞 4

- 收藏

- 分享

- 文章举报

小哪吒~

发布了35 篇原创文章 · 获赞 91 · 访问量 2万+

私信

关注

小哪吒~

发布了35 篇原创文章 · 获赞 91 · 访问量 2万+

私信

关注

- 大数据入入门——退役旧数据节点

- HDFS新增节点与删除节点

- hdfs 删除和新增节点

- Hadoop入门--HDFS(单节点)配置和部署 (一)

- 大数据HDFS入门以及个人见解

- Hadoop入门--HDFS(单节点)配置和部署 (一)

- 每天收获一点点------Hadoop之HDFS基础入门

- 大数据从入门到精通学习路线分享

- DRUID: 新增MiddleManager节点遇到的坑

- 用Apache Spark进行大数据处理——第一部分:入门介绍

- Zookeeper入门之使用curator连接zookeeper并且进行节点的增删改查及ACL

- 大数据入门教程系列之Hive的Java API 操作

- LINUX x86-64 RAC新增一个节点

- Hadoop HDFS编程 API入门系列之HdfsUtil版本2(七)

- Hadoop教程(三):HDFS、MapReduce、程序入门实践

- 新增树型节点

- Hadoop学习笔记—2.不怕故障的海量存储:HDFS基础入门

- 大数据分析入门课程8--Spark基础

- 大数据Hadoop之HDFS读取过程总结

- HDFS入门