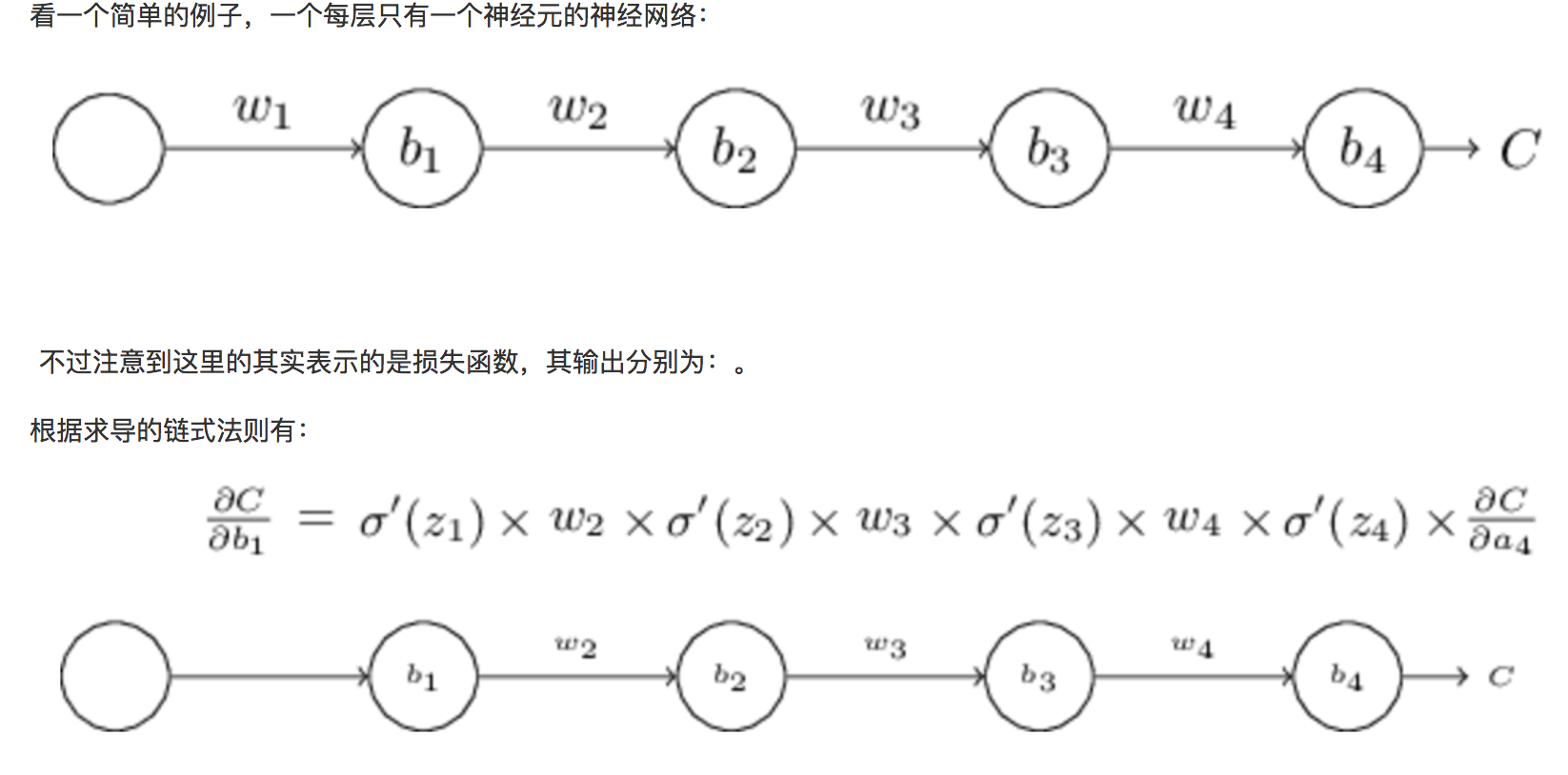

反向传播与梯度消失梯度爆炸

2018-08-24 01:02

309 查看

反向传播:https://zhuanlan.zhihu.com/p/22473137

https://blog.csdn.net/cppjava_/article/details/68941436

2.解决梯度爆炸问题的方法

通常会使用一种叫”clip gradients “的方法. 它能有效地权重控制在一定范围之内.

算法步骤如下。

- 首先设置一个梯度阈值:clip_gradient

- 在后向传播中求出各参数的梯度,这里我们不直接使用梯度进去参数更新,我们求这些梯度的l2范数

- 然后比较梯度的l2范数||g||与clip_gradient的大小

- 如果前者大,求缩放因子clip_gradient/||g||, 由缩放因子可以看出梯度越大,则缩放因子越小,这样便很好地控制了梯度的范围

- 最后将梯度乘上缩放因子便得到最后所需的梯度

- https://blog.csdn.net/u010814042/article/details/76154391

相关文章推荐

- Coursera | Andrew Ng (02-week-1-1.10)—梯度消失与梯度爆炸

- 梯度消失与梯度爆炸

- 梯度下降与反向传播详解

- 深度学习:梯度消失和梯度爆炸

- 神经网络反向传播时的梯度

- 关于梯度消失,梯度爆炸的问题

- 十三、神经网络梯度不稳定问题(即梯度消失 & 梯度爆炸问题)

- 神经网络之梯度下降与反向传播(上)

- 反向传播与梯度下降的基本概念

- 梯度下降法与反向传播

- 神经网络之梯度下降法和反向传播BP

- 关于梯度消失,梯度爆炸的问题

- 实现属于自己的TensorFlow(二) - 梯度计算与反向传播

- 神经网络之梯度下降与反向传播(下)

- [机器学习] UFLDL笔记 - Convolutional Neural Network - 反向传播与梯度计算

- 深度神经网络的梯度不稳定问题--梯度消失与梯度爆炸

- 梯度消失(vanishing gradient)与梯度爆炸(exploding gradient)问题

- 关于梯度消失/爆炸理解

- mxnet-梯度与反向传播

- CNN中的梯度的求法和反向传播过程