centos7系统单机安装部署hadoop2.6.5

2018-03-17 23:00

609 查看

今天单机安装部署Hadoop,就顺便记录一下安装过程

检查命令:java -version(查看版本,使用这个命令就可以)

或

rpm -qa | grep java(查看所有安装的软件包中带有Java的)

如果发现有安装好的OpenJDK以及安装包的话那么首先依次执行卸载。

卸载命令:

yum -y remove ...(省略号为java安装包名称)

或

rpm -e -–nodeps tzdata-java-2012c-1.el6.noarch

rpm -e -–nodeps java-1.6.0-openjdk-1.6.0.0-1.45.1.11.1.el6.x86_64(务必注意–nodeps前的两个横杠)

现在便可以进行安装

1)将jdk-8u162-linux-x64.tar.gz移动到了home文件夹下解压,并将其重命名为Java

2)配置环境变量#set java environment

export JAVA_HOME=/usr/java/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH使配置文件生效:source /etc/profile

输入java -version看是否安装成功

如上图所示正常显示了jdk版本,到此为止就已经安装成功了。

2)配置hadoopa.修改/usr/hadoop/etc/hadoop/hadoop-env.sh 文件的java环境,将java安装路径加进去export JAVA_HOME=/usr/java/jdk1.8.0_162b.配置hadoop环境变量export HADOOP_HOME=/usr/hadoop/

c.修改/usr/hadoop/etc/hadoop/core-site.xml 文件<configuration>

<!-- 指定HDFS老大(namenode)的通信地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储路径 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/hadoop/tmp</value>

</property>

</configuration>d.修改/usr/hadoop/etc/hadoop/hdfs-site.xml<configuration>

<property>

<name>dfs.name.dir</name>

<value>/usr/hadoop/hdfs/name</value>

<description>namenode上存储hdfs名字空间元数据 </description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/usr/hadoop/hdfs/data</value>

<description>datanode上数据块的物理存储位置</description>

</property>

<!-- 设置hdfs副本数量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration> e.ssh免密登录ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

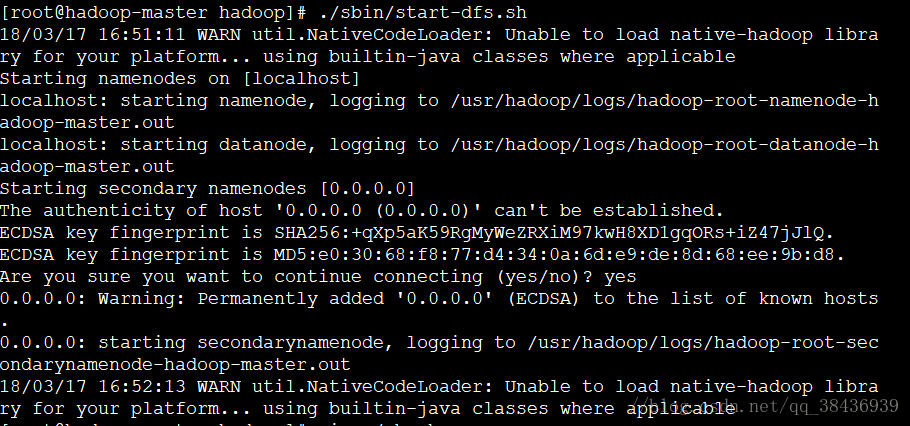

chmod 0600 ~/.ssh/authorized_keys f.hdfs启动与停止第一次启动hdfs需要格式化在hadoop文件夹下执行 ./bin/hdfs namenode -format命令进行格式化hdfs启动:start-dfs.sh hdfs停止命令:stop-dfs.sh若在启动hdfs时出现Unable to load native-hadoop library for your platform...提示hadoop不能加载本地库。

若程序和操作系统都是64位的,那也许就是少了些配置,试试下面的方法:首先在bashrc中加入如下配置:

vim ~/.bashrc

配置如下

再去执行启动dfs/yarn,成功解决了我的问题

g.浏览器输入:http://192.168.136.140:50070 (IP为自己系统的地址)

h.接下来配置yarn文件

配置/usr/hadoop/etc/hadoop/mapred-site.xml 。这里注意一下,hadoop里面默认是mapred-site.xml.template 文件,如果配置yarn,把mapred-site.xml.template 重命名为mapred-site.xml 。mv mapred-site.xml.template mapred-site.xml 配置mapred-site.xml文件<configuration>

<!-- 通知框架MR使用YARN -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>配置/usr/hadoop//etc/hadoop/yarn-site.xml文件<configuration>

<!-- reducer取数据的方式是mapreduce_shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration> 启动yarn :start-yarn.sh 停止yarn:stop-yarn.sh

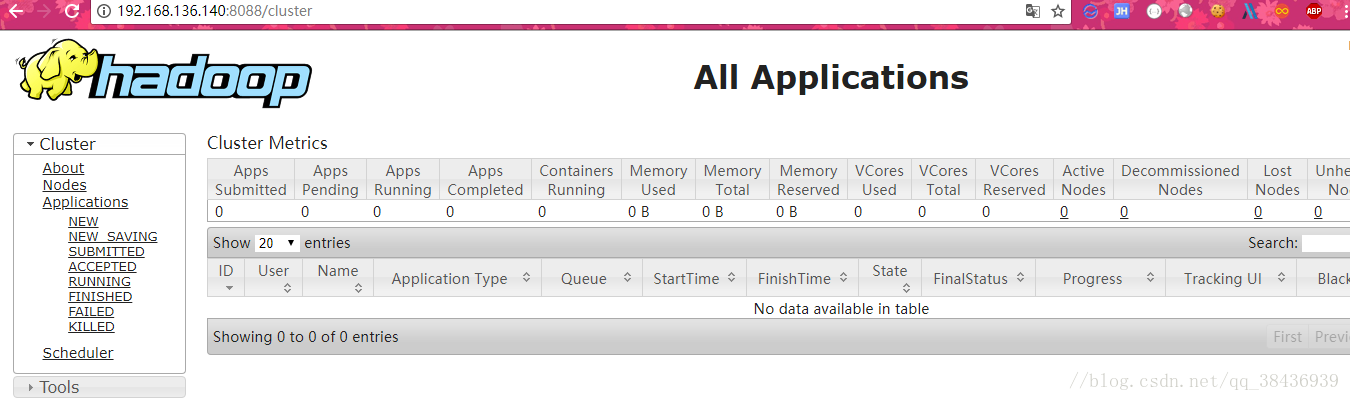

i.验证Hadoop安装

浏览器输入http://192.168.136.140:8088 (8088是默认端口)

可以用jps命令查看启动了什么进程:

1 首先需要下载jdk和hadoop的安装包

我安装的版本是Hadoop-2.6.5.tar.gz(注意不要下载成hadoop-2.6.5-src.tar.gz)和jdk-8u162-linux-x64.tar.gz2 安装jdk

检查并卸载OpenJDK

第一步检查系统是否自带了OpenJDK以及相关安装包,如果有的话则应先将其卸载。检查命令:java -version(查看版本,使用这个命令就可以)

或

rpm -qa | grep java(查看所有安装的软件包中带有Java的)

如果发现有安装好的OpenJDK以及安装包的话那么首先依次执行卸载。

卸载命令:

yum -y remove ...(省略号为java安装包名称)

或

rpm -e -–nodeps tzdata-java-2012c-1.el6.noarch

rpm -e -–nodeps java-1.6.0-openjdk-1.6.0.0-1.45.1.11.1.el6.x86_64(务必注意–nodeps前的两个横杠)

现在便可以进行安装

1)将jdk-8u162-linux-x64.tar.gz移动到了home文件夹下解压,并将其重命名为Java

2)配置环境变量#set java environment

export JAVA_HOME=/usr/java/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH使配置文件生效:source /etc/profile

输入java -version看是否安装成功

如上图所示正常显示了jdk版本,到此为止就已经安装成功了。

3 安装hadoop

1)将Hadoop-2.6.5.tar.gz移到home文件夹下解压,并重命名为hadoop2)配置hadoopa.修改/usr/hadoop/etc/hadoop/hadoop-env.sh 文件的java环境,将java安装路径加进去export JAVA_HOME=/usr/java/jdk1.8.0_162b.配置hadoop环境变量export HADOOP_HOME=/usr/hadoop/

export PATH=${HADOOP_HOME}/bin:${HADOOP_HOME}/sbin:$PATH使用source /etc/profile使更改后的配置文件生效c.修改/usr/hadoop/etc/hadoop/core-site.xml 文件<configuration>

<!-- 指定HDFS老大(namenode)的通信地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储路径 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/hadoop/tmp</value>

</property>

</configuration>d.修改/usr/hadoop/etc/hadoop/hdfs-site.xml<configuration>

<property>

<name>dfs.name.dir</name>

<value>/usr/hadoop/hdfs/name</value>

<description>namenode上存储hdfs名字空间元数据 </description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/usr/hadoop/hdfs/data</value>

<description>datanode上数据块的物理存储位置</description>

</property>

<!-- 设置hdfs副本数量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration> e.ssh免密登录ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

chmod 0600 ~/.ssh/authorized_keys f.hdfs启动与停止第一次启动hdfs需要格式化在hadoop文件夹下执行 ./bin/hdfs namenode -format命令进行格式化hdfs启动:start-dfs.sh hdfs停止命令:stop-dfs.sh若在启动hdfs时出现Unable to load native-hadoop library for your platform...提示hadoop不能加载本地库。

若程序和操作系统都是64位的,那也许就是少了些配置,试试下面的方法:首先在bashrc中加入如下配置:

vim ~/.bashrc

配置如下

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export HADOOP_HOME=/home/hadoop/ export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib:$HADOOP_COMMON_LIB_NATIVE_DIR"使上面配置生效:source ~/.bashrc

再去执行启动dfs/yarn,成功解决了我的问题

g.浏览器输入:http://192.168.136.140:50070 (IP为自己系统的地址)

h.接下来配置yarn文件

配置/usr/hadoop/etc/hadoop/mapred-site.xml 。这里注意一下,hadoop里面默认是mapred-site.xml.template 文件,如果配置yarn,把mapred-site.xml.template 重命名为mapred-site.xml 。mv mapred-site.xml.template mapred-site.xml 配置mapred-site.xml文件<configuration>

<!-- 通知框架MR使用YARN -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>配置/usr/hadoop//etc/hadoop/yarn-site.xml文件<configuration>

<!-- reducer取数据的方式是mapreduce_shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration> 启动yarn :start-yarn.sh 停止yarn:stop-yarn.sh

i.验证Hadoop安装

浏览器输入http://192.168.136.140:8088 (8088是默认端口)

可以用jps命令查看启动了什么进程:

相关文章推荐

- Centos7系统Hadoop集群cm5.9.0安装文档

- Ubuntu系统下的Hadoop集群(1)_Hadoop安装教程_单机/伪分布式配置

- hadoop2.7.3在centos7上部署安装(单机版)

- CentOS7 64位系统安装配置hadoop2.7.2

- Hadoop单机安装部署

- Hadoop2.0单机环境安装部署

- centos7 部署Elasticsearch单机/集群并安装head插件实现ES集群的可视化管理

- centos6.5/centos7安装部署企业内部知识管理社区系统wecenter

- 在Linux系统设置共享文件夹、Hadoop单机/伪分布部署,运行Hadoop Wordcount单词统计实例

- Centos7,Hadoop-2.5.1下HBase-1.1.2安装部署

- Centos7 安装Hadoop3.x 完全分布式部署

- centos6.5/centos7安装部署企业内部知识管理社区系统wecenter

- hadoop 单机安装与部署

- 安装单机Hadoop系统(完整版)——Mac

- linux下从安装JDK到安装ssh到hadoop单机伪分布式部署

- HADOOP单机系统安装

- Linux 环境下部署Hadoop 2.x,建议尝试64位系统下进行本地编译的安装方式

- centos6.5/centos7安装部署企业内部知识管理社区系统wecenter

- Hadoop 1.x 单机(本地)模式安装部署

- CentOS7系统安装hadoop伪分布式系统