机器学习之决策树算法

2018-01-29 19:31

260 查看

1.决策树概念:

判定树是一个类似于流程图的树结构:其中,每个内部结点表示在一个属性上的测试,每个分支代表一个属性输出,而每个树叶结点代表类或类分布。树的最顶层是根结点。

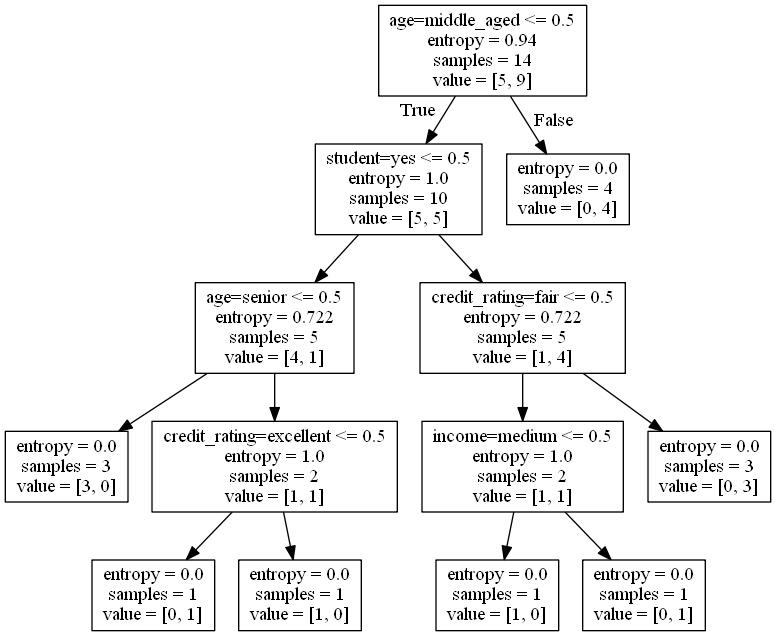

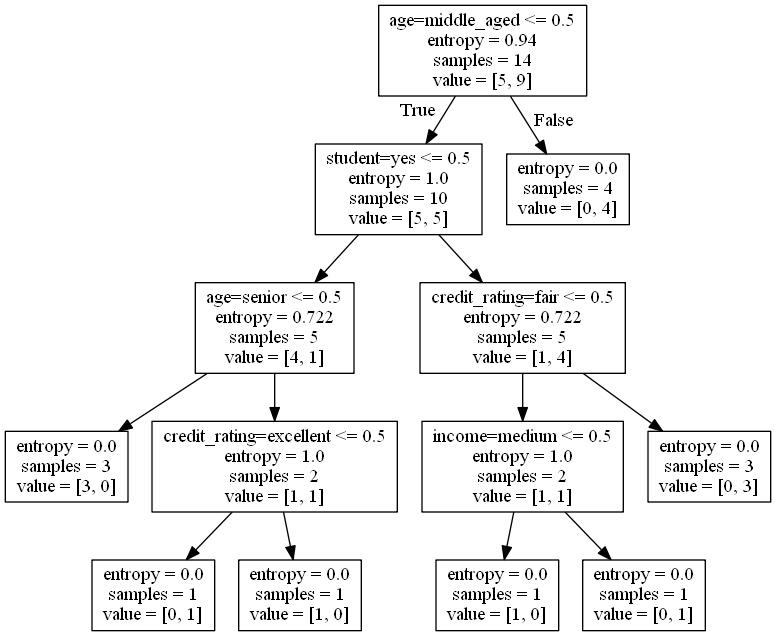

以下表的14个样本数据为例来说明决策树算法

构造决策树:

2.具体算法实现(ID3算法)

2.1 信源熵的概念

我们首先知道信息熵是考虑该随机变量的所有可能取值,即所有可能发生事件所带来的信息量的期望。公式如下:

条件熵H(Y|X)表示在已知随机变量X的条件下随机变量Y的不确定性,其具体公式:

2.2计算上面l列表样本的条件熵:

同理得出Gain(income) = 0.029bits, Gain(student) = 0.151bits, Gain(credit_rating)=0.048bits

2.2 每次选取条件熵最大的特征作为根节点进行分类

3.详细过程

树以代表训练样本的单个结点开始(步骤1)。

如果样本都在同一个类,则该结点成为树叶,并用该类标号(步骤2 和3)。

否则,算法使用称为信息增益的基于熵的度量作为启发信息,选择能够最好地将样本分类的属性(步骤6)。该属性成为该结点的“测试”或“判定”属性(步骤7)。在算法的该版本中,

所有的属性都是分类的,即离散值。连续属性必须离散化。

对测试属性的每个已知的值,创建一个分枝,并据此划分样本(步骤8-10)。

算法使用同样的过程,递归地形成每个划分上的样本判定树。一旦一个属性出现在一个结点上,就不必该结点的任何后代上考虑它(步骤13)。

递归划分步骤仅当下列条件之一成立停止:

(a) 给定结点的所有样本属于同一类(步骤2 和3)。

(b) 没有剩余属性可以用来进一步划分样本(步骤4)。在此情况下,使用多数表决(步骤5)。

这涉及将给定的结点转换成树叶,并用样本中的多数所在的类标记它。替换地,可以存放结

点样本的类分布。

(c) 分枝

test_attribute = a i 没有样本(步骤11)。在这种情况下,以 samples 中的多数类

创建一个树叶(步骤12)

4.python3 代码实现(pycharm)

5.将生成的dot文件使用Graphviz转化成树状图

判定树是一个类似于流程图的树结构:其中,每个内部结点表示在一个属性上的测试,每个分支代表一个属性输出,而每个树叶结点代表类或类分布。树的最顶层是根结点。

以下表的14个样本数据为例来说明决策树算法

构造决策树:

2.具体算法实现(ID3算法)

2.1 信源熵的概念

我们首先知道信息熵是考虑该随机变量的所有可能取值,即所有可能发生事件所带来的信息量的期望。公式如下:

条件熵H(Y|X)表示在已知随机变量X的条件下随机变量Y的不确定性,其具体公式:

2.2计算上面l列表样本的条件熵:

同理得出Gain(income) = 0.029bits, Gain(student) = 0.151bits, Gain(credit_rating)=0.048bits

2.2 每次选取条件熵最大的特征作为根节点进行分类

3.详细过程

树以代表训练样本的单个结点开始(步骤1)。

如果样本都在同一个类,则该结点成为树叶,并用该类标号(步骤2 和3)。

否则,算法使用称为信息增益的基于熵的度量作为启发信息,选择能够最好地将样本分类的属性(步骤6)。该属性成为该结点的“测试”或“判定”属性(步骤7)。在算法的该版本中,

所有的属性都是分类的,即离散值。连续属性必须离散化。

对测试属性的每个已知的值,创建一个分枝,并据此划分样本(步骤8-10)。

算法使用同样的过程,递归地形成每个划分上的样本判定树。一旦一个属性出现在一个结点上,就不必该结点的任何后代上考虑它(步骤13)。

递归划分步骤仅当下列条件之一成立停止:

(a) 给定结点的所有样本属于同一类(步骤2 和3)。

(b) 没有剩余属性可以用来进一步划分样本(步骤4)。在此情况下,使用多数表决(步骤5)。

这涉及将给定的结点转换成树叶,并用样本中的多数所在的类标记它。替换地,可以存放结

点样本的类分布。

(c) 分枝

test_attribute = a i 没有样本(步骤11)。在这种情况下,以 samples 中的多数类

创建一个树叶(步骤12)

4.python3 代码实现(pycharm)

from sklearn.feature_extraction import DictVectorizer #转化成矢量矩阵

import csv

from sklearn import tree #构建决策树

from sklearn import preprocessing #数据预处理

from sklearn.externals.six import StringIO

allElectronicsData = open(r'F:\python学习\DTree_2\AllElectronics.csv')

reader = csv.reader(allElectronicsData) #reader 是每一行元素的集合

headers = next(reader) #headers 列表存储的是第一行的值

print(headers)

featureList =[]

labelList = []

for row in reader: #row遍历csv格式文件中的每一行,是列表类型

# print(row)

rowDict = {}

labelList.append(row[len(row) - 1]) #取每一行的最后一个元素附在列表中

for i in range(1,len(row)-1) : #遍历当前行的特征

rowDict[headers[i]] = row[i] #将当前行的特征及特征值封装成一个字典

featureList.append(rowDict) #所有行的特征字典放在一个列表中

print(featureList)

vec = DictVectorizer()

dummyX = vec.fit_transform(featureList).toarray() #调用库将字典映射成一个矢量

print("dummyX:\n " + str(dummyX))

print(vec.get_feature_names()) #打印出分类依据

#将最后一列 labelList 列表二值化

lb = preprocessing.LabelBinarizer()

dummyY = lb.fit_transform(labelList)

print("dummyY: " + str(dummyY))

clf = tree.DecisionTreeClassifier(criterion='entropy')#决策树分类依据为信源熵 critertion = entropy

clf_result = clf.fit(dummyX,dummyY)

print(clf)

with open("allElectronic.dot", 'w') as f: #输出决策树生成dot文件

f = tree.export_graphviz(clf, feature_names=vec.get_feature_names(), out_file=f)5.将生成的dot文件使用Graphviz转化成树状图

相关文章推荐

- 【机器学习】决策树算法以及熵、条件熵、信息增益等整理

- 机器学习——决策树算法

- 机器学习:决策树算法

- [Java][机器学习]决策树算法

- [机器学习]决策树算法的理论基础

- 机器学习(三)决策树算法Decision Tree

- 机器学习——决策树算法原理及案例

- 机器学习(三)决策树算法ID3的实现

- 机器学习中的决策树算法

- 机器学习故事汇-决策树算法

- 机器学习-决策树算法代码详解

- 机器学习实战第三章决策树算法照葫芦画瓢算法实践

- 机器学习之决策树算法概要

- 机器学习(一):决策树算法及使用python构造一个决策树

- 机器学习--决策树算法

- 机器学习——决策树算法原理及案例

- 机器学习理论决策树算法第一卷

- 【机器学习基础】决策树算法

- 机器学习之决策树算法python实现

- 【机器学习】2.决策树算法