跟我一起hadoop的(1)-hadoop2.6安装与使用

2017-12-20 10:30

323 查看

转载地址:https://yq.aliyun.com/articles/38310?spm=5176.100239.blogcont38308.15.1pbgGY

Hadoop的的三种安装方式:

本地(独立)模式

伪分布式模式

完全分布式模式

$ sudo apt-get install ssh

(centos 安装命令并不是这个昂,详见os安装ssh)

$ sudo apt-get install rsync

详见:http ://hadoop.apache.org/docs/stable/hadoop-project-dist/hadoop-common/SingleCluster.html

组态

修改下边:

等/ hadoop的/芯-site.xml中:

等/ hadoop的/ HDFS-site.xml中:

配置参数如下:

等/ hadoop的/ mapred-site.xml中:

等/ hadoop的/纱-site.xml中:

启动ResourceManager守护进程和NodeManager守护进程:

浏览ResourceManager的Web界面; 默认情况下它可用于:

ResourceManager - http:// localhost:8088 /

运行MapReduce作业。

当你完成后,停止守护进程:

输入:

HTTP://本地主机:8088 /

可以看到

启动纱后

格式化文件系统:

启动NameNode守护进程和DataNode守护进程:

hadoop守护进程日志输出写入$HADOOP_LOG_DIR目录(默认为$HADOOP_HOME

/日志)。

浏览NameNode的Web界面; 默认情况下它可用于:

NameNode - http:// localhost:50070

/

输入后得到:

然后执行测试

制作执行MapReduce作业所需的HDFS目录:

将输入文件复制到分布式文件系统中:

运行一些提供的例子:

检查输出文件:

将输出文件从分布式文件系统复制到本地文件系统并检查它们:

要么

查看分布式文件系统上的输出文件:

看运行的情况:

查看结果

测试执行成功,可以编写本地代码了。

下载源码:

下载过程:

编译插件:

cd src / contrib / eclipse-plugin

ant jar -Dversion = 2.6.0 -Declipse.home = / usr / local / eclipse -Dhadoop.home = / usr / local / hadoop-2.6.0 //路径根据自己的配置

复制编译好的罐到蚀插件目录,重启蚀

配置hadoop安装目录

窗口 - >首选项 - > hadoop Map / Reduce - > Hadoop安装目录

配置Map / Reduce视图

窗口 - >打开透视 - >其他 - >地图/缩小 - >点击“确定”

窗口→显示视图→其他 - >地图/减少地点 - >点击“确定”

控制台会多出一个“Map / Reduce Locations”的标签页

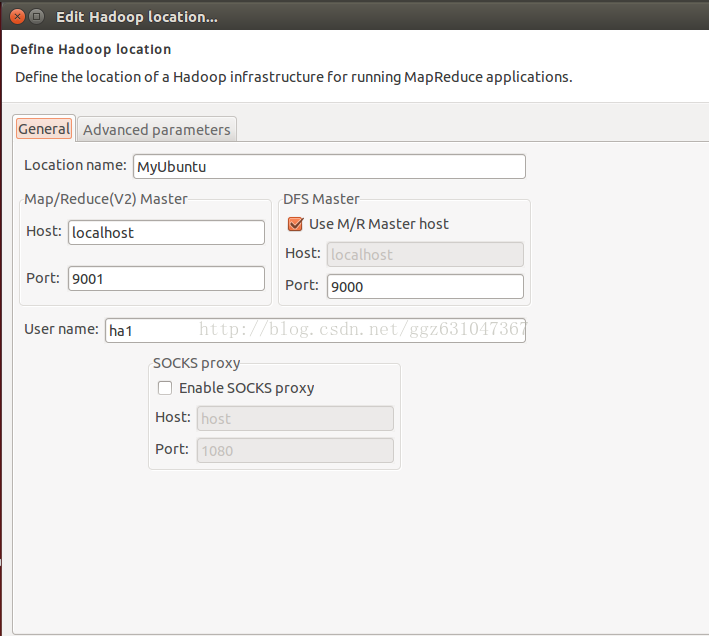

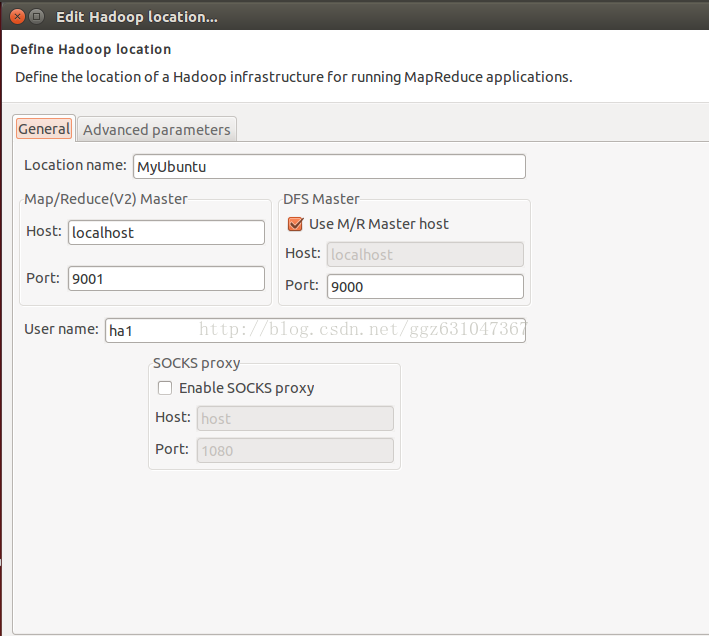

在“Map / Reduce Locations”标签页中点击图标<大象+>或者在空白的地方右键,选择“New Hadoop location ...”,弹出对话框“New hadoop location ...”,配置如下内容:将ha1改为自己的Hadoop的用户

注意:MR Master和DFS Master配置必须和mapred-site.xml和core-site.xml等配置文件一致。

打开Project Explorer,查看HDFS文件系统。

新建的Map / Reduce任务

File-> New-> project-> Map / Reduce Project-> Next

编写字计数类:记得先把服务都起来

用户/为admin123 /输入/ hadoop的是你上传在HDFS的文件夹(自己创建),里面放要处理的文件.ouput1放输出结果

将程序放在hadoop集群上运行:右键 - > Runas - >在Hadoop上运行,最终的输出结果会在HDFS相应的文件夹下显示。至此,ubuntu下hadoop-2.6.0 eclipse插件配置完成。

遇到异常

1、改变输出路径。

2、删除重新建。

运行完成后看结果:

伪分布式

Hadoop的的三种安装方式:本地(独立)模式

伪分布式模式

完全分布式模式

安装之前需要

$ sudo apt-get install ssh (centos 安装命令并不是这个昂,详见os安装ssh)

$ sudo apt-get install rsync

详见:http ://hadoop.apache.org/docs/stable/hadoop-project-dist/hadoop-common/SingleCluster.html

伪分布式配置

组态

修改下边:

等/ hadoop的/芯-site.xml中:

<结构> <属性> <名称> fs.defaultFS </名称> <值> HDFS://本地主机:9000 </值> </属性> </配置>

等/ hadoop的/ HDFS-site.xml中:

<结构> <属性> <名称> dfs.replication </名称> <值> 1 </值> </属性> </配置>

配置SSH

$ ssh-keygen -t dsa -P''-f〜/ .ssh / id_dsa $ cat〜/ .ssh / id_dsa.pub >>〜/ .ssh / authorized_keys

如果想运行在纱上

需要执行下边的步骤:

配置参数如下:

等/ hadoop的/ mapred-site.xml中:

<结构> <属性> <名称> mapreduce.framework.name </名称> <值>纱</值> </属性> </配置>

等/ hadoop的/纱-site.xml中:

<结构> <属性> <名称> yarn.nodemanager.aux服务</名称> <值> mapreduce_shuffle </值> </属性> </配置>

启动ResourceManager守护进程和NodeManager守护进程:

$ sbin / start-yarn.sh

浏览ResourceManager的Web界面; 默认情况下它可用于:

ResourceManager - http:// localhost:8088 /

运行MapReduce作业。

当你完成后,停止守护进程:

$ sbin / stop-yarn.sh

输入:

HTTP://本地主机:8088 /

可以看到

启动纱后

格式化文件系统:

$ bin / hdfs namenode -format

启动NameNode守护进程和DataNode守护进程:

$ sbin / start-dfs.sh

hadoop守护进程日志输出写入$HADOOP_LOG_DIR目录(默认为$HADOOP_HOME

/日志)。

浏览NameNode的Web界面; 默认情况下它可用于:

NameNode - http:// localhost:50070

/

输入后得到:

然后执行测试

制作执行MapReduce作业所需的HDFS目录:

$ bin / hdfs dfs -mkdir / user $ bin / hdfs dfs -mkdir / user / <username>

将输入文件复制到分布式文件系统中:

$ bin / hdfs dfs -put etc / hadoop输入

运行一些提供的例子:

$ bin / hadoop jar share / hadoop / mapreduce / hadoop-mapreduce-examples-2.6.0.jar grep input output'dfs [az。] +'

检查输出文件:

将输出文件从分布式文件系统复制到本地文件系统并检查它们:

$ bin / hdfs dfs -get输出输出 $ cat输出/ *

要么

查看分布式文件系统上的输出文件:

$ bin / hdfs dfs -cat output / *

看运行的情况:

查看结果

测试执行成功,可以编写本地代码了。

日食hadoop2.6插件使用

下载源码:git clone https://github.com/winghc/hadoop2x-eclipse-plugin.git

下载过程:

编译插件:

cd src / contrib / eclipse-plugin

ant jar -Dversion = 2.6.0 -Declipse.home = / usr / local / eclipse -Dhadoop.home = / usr / local / hadoop-2.6.0 //路径根据自己的配置

复制编译好的罐到蚀插件目录,重启蚀

配置hadoop安装目录

窗口 - >首选项 - > hadoop Map / Reduce - > Hadoop安装目录

配置Map / Reduce视图

窗口 - >打开透视 - >其他 - >地图/缩小 - >点击“确定”

窗口→显示视图→其他 - >地图/减少地点 - >点击“确定”

控制台会多出一个“Map / Reduce Locations”的标签页

在“Map / Reduce Locations”标签页中点击图标<大象+>或者在空白的地方右键,选择“New Hadoop location ...”,弹出对话框“New hadoop location ...”,配置如下内容:将ha1改为自己的Hadoop的用户

注意:MR Master和DFS Master配置必须和mapred-site.xml和core-site.xml等配置文件一致。

打开Project Explorer,查看HDFS文件系统。

新建的Map / Reduce任务

File-> New-> project-> Map / Reduce Project-> Next

编写字计数类:记得先把服务都起来

/ **

*

* /

package com.zongtui;

/ **

* ClassName:WordCount <br/>

*功能:TODO ADD功能。<BR/>

<br/> * date:Jun 28,2015 5:34:18 AM <br/>

*

* @作者zhangfeng

* @version

* @自JDK 1.7

* /

import java.io.IOException;

import java.util.Iterator;

import java.util.StringTokenizer;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapred.FileInputFormat;

import org.apache.hadoop.mapred.FileOutputFormat;

import org.apache.hadoop.mapred.JobClient;

import org.apache.hadoop.mapred.JobConf;

import org.apache.hadoop.mapred.MapReduceBase;

import org.apache.hadoop.mapred.Mapper;

import org.apache.hadoop.mapred.OutputCollector;

import org.apache.hadoop.mapred.Reducer;

进口org.apache.hadoop.mapred.Reporter;

import org.apache.hadoop.mapred.TextInputFormat;

import org.apache.hadoop.mapred.TextOutputFormat;

公共 类WordCount {

公共 静态 类地图扩展 MapReduceBase 实现

Mapper <LongWritable,文本,文本,IntWritable> {

私人 最终 静态 IntWritable一= 新 IntWritable(1 );

私人文字= 新文字();

public void map(LongWritable key,Text value,

OutputCollector <Text,IntWritable> 输出,Reporter记者)

抛出IOException {

String line = value.toString();

StringTokenizer tokenizer = new StringTokenizer(line);

while (tokenizer.hasMoreTokens()){

word.set(tokenizer.nextToken());

output.collect(word,one);

}

}

}

public static class Reduce extends MapReduceBase implements

Reducer <Text,IntWritable,Text,IntWritable> {

public void reduce(Text key,Iterator <IntWritable> values,

OutputCollector <Text,IntWritable> 输出,Reporter记者)

抛出IOException {

int sum = 0 ;

while (values.hasNext()){

sum + = values.next()。get();

}

output.collect(key,new IntWritable(sum));

}

}

公共 静态 无效的主要(字符串[]参数)抛出异常{

JobConf CONF = 新 JobConf(字计数。类);

conf.setJobName( “wordcount” );

conf.setOutputKeyClass(文本类);

conf.setOutputValueClass(IntWritable 类);

conf.setMapperClass(地图类);

conf.setReducerClass(降低。类);

conf.setInputFormat(的TextInputFormat 类);

conf.setOutputFormat(TextOutputFormat 类);

FileInputFormat.setInputPaths(conf,new Path(args [0 ]));

FileOutputFormat.setOutputPath(conf,new Path(args [1 ]));

JobClient.runJob(CONF);

}

}用户/为admin123 /输入/ hadoop的是你上传在HDFS的文件夹(自己创建),里面放要处理的文件.ouput1放输出结果

将程序放在hadoop集群上运行:右键 - > Runas - >在Hadoop上运行,最终的输出结果会在HDFS相应的文件夹下显示。至此,ubuntu下hadoop-2.6.0 eclipse插件配置完成。

遇到异常

线程“main”中的异常org.apache.hadoop.mapred.FileAlreadyExistsException:输出目录hdfs:// localhost:9000 / output已存在 于org.apache.hadoop.mapred.FileOutputFormat.checkOutputSpecs(FileOutputFormat.java:132 ) 在org.apache.hadoop.mapreduce.JobSubmitter.checkSpecs(JobSubmitter.java: 564 ) at org.apache.hadoop.mapreduce.JobSubmitter.submitJobInternal(JobSubmitter.java:432) at org.apache.hadoop.mapreduce.Job$10.run(Job.java:1296) at org.apache.hadoop.mapreduce.Job$10.run(Job.java:1293) at java.security.AccessController.doPrivileged(Native Method) at javax.security.auth.Subject.doAs(Subject.java:415) at org.apache.hadoop.security.UserGroupInformation.doAs(UserGroupInformation.java:1628) at org.apache.hadoop.mapreduce.Job.submit(Job.java:1293) at org.apache.hadoop.mapred.JobClient$1.run(JobClient.java:562) at org.apache.hadoop.mapred.JobClient$1.run(JobClient.java:557) at java.security.AccessController.doPrivileged(Native Method) at javax.security.auth.Subject.doAs(Subject.java:415) at org.apache.hadoop.security.UserGroupInformation.doAs(UserGroupInformation.java:1628) at org.apache.hadoop.mapred.JobClient.submitJobInternal(JobClient.java:557) at org.apache.hadoop.mapred.JobClient.submitJob(JobClient.java:548) at org.apache.hadoop.mapred.JobClient.runJob(JobClient.java:833) at com.zongtui.WordCount.main(WordCount.java:83)

1、改变输出路径。

2、删除重新建。

运行完成后看结果:

相关文章推荐

- 跟我一起hadoop(1)-hadoop2.6安装与使用

- 跟我一起hadoop(1)-hadoop2.6安装与使用

- Hadoop2.6+jdk8的安装部署(1)——使用jar包安装部署【详细】

- hadoop2.6伪分布式安装和使用(centos7)

- Hadoop2.6+jdk8的安装部署(1)——使用jar包安装部署【详细】

- hadoop学习--安装使用

- 在VMWare Workstation上使用RedHat Linux安装和配置Hadoop群集环境01_虚拟机的安装

- hadoop工具hive安装使用

- hadoop-0.20.2安装及简单使用

- hadoop安装配置:使用cloudrea

- 使用FreeBSD的ports安装hadoop

- [置顶] CentOS 安装 hadoop hbase 使用 cloudera 版本。(一)

- 配置文件、虚拟机-如何使用vagrant在虚拟机安装hadoop集群-by小雨

- hadoop-0.20.2安装及简单使用 ubuntu

- VMware中使用CentOS安装并测试Hadoop

- 如何使用vagrant在虚拟机安装hadoop集群

- 如何使用vagrant在虚拟机安装hadoop集群

- VMWare Workstation上使用RedHat Linux安装和配置Hadoop群集环境03_配置虚拟机之间SSH无密码登录

- 在VMWare Workstation上使用RedHat Linux安装和配置Hadoop群集环境03_配置虚拟机之间SSH无密码登录

- hadoop安装及使用