利用docker搭建spark hadoop workbench

2017-11-29 10:51

288 查看

目的

用docker实现所有服务

在spark-notebook中编写Scala代码,实时提交到spark集群中运行

在HDFS中存储数据文件,spark-notebook中直接读取

组件

Spark (Standalone模式, 1个master节点 + 可扩展的worker节点)

Spark-notebook

Hadoop name node

Hadoop data node

HDFS FileBrowser

实现

最初用了Big Data Europe的docker-spark-hadoop-workbench,但是docker 服务运行后在spark-notebook中运行代码会出现经典异常:

View Code

发现是因为spark-notebook和spark集群使用的spark版本不一致. 于是fork了Big Data Europe的repo,在此基础上做了一些修改,基于spark2.11-hadoop2.7实现了一个可用的workbench.

运行docker服务

扩展spark worker节点

测试服务

各个服务的URL如下:

用docker实现所有服务

在spark-notebook中编写Scala代码,实时提交到spark集群中运行

在HDFS中存储数据文件,spark-notebook中直接读取

组件

Spark (Standalone模式, 1个master节点 + 可扩展的worker节点)

Spark-notebook

Hadoop name node

Hadoop data node

HDFS FileBrowser

实现

最初用了Big Data Europe的docker-spark-hadoop-workbench,但是docker 服务运行后在spark-notebook中运行代码会出现经典异常:

java.lang.ClassCastException: cannot assign instance of scala.collection.immutable.List$SerializationProxy to field org.apache.spark.rdd.RDD.org$apache$spark$rdd$RDD$$dependencies_ of type scala.collection.Seq in instance of org.apache.spark.rdd.MapPartitionsRDD

View Code

发现是因为spark-notebook和spark集群使用的spark版本不一致. 于是fork了Big Data Europe的repo,在此基础上做了一些修改,基于spark2.11-hadoop2.7实现了一个可用的workbench.

运行docker服务

docker-compose up -d

扩展spark worker节点

docker-compose scale spark-worker=3

测试服务

各个服务的URL如下:

Namenode: http://localhost:50070 Datanode: http://localhost:50075 Spark-master: http://localhost:8080 Spark-notebook: http://localhost:9001 Hue (HDFS Filebrowser): http://localhost:8088/home[/code]

以下是各个服务的运行截图

HDFS Filebrower

Spark集群

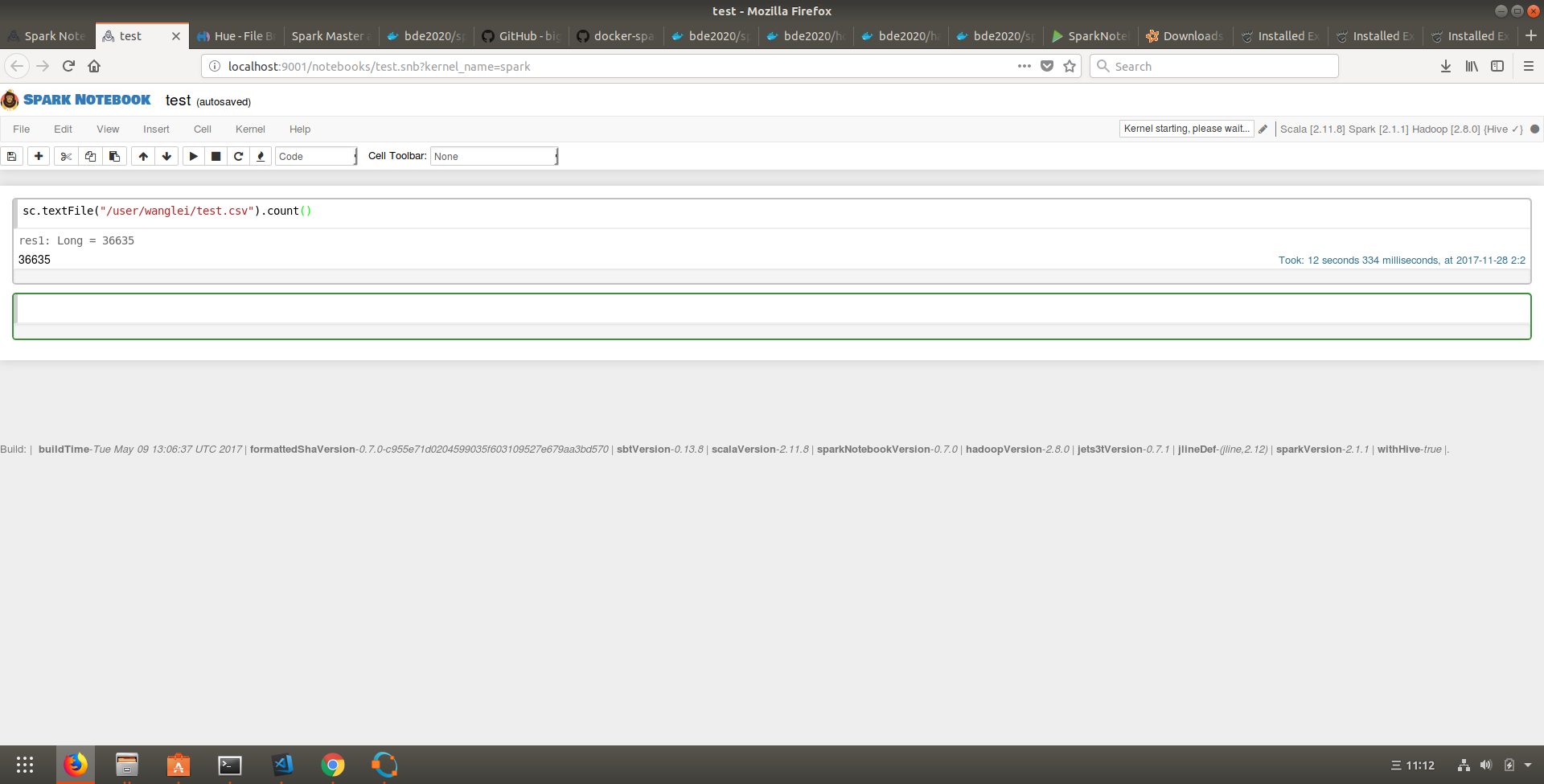

Spark-notebook

运行例子

1. 上传csv文件到HDFS FileBrowser,

2. Spark notebook新建一个notebook

3. 在新建的notebook里操作HDFS的csv文件

具体的步骤参考这里

以下是spark-notebook运行的截图:

代码链接

Github

相关文章推荐

- 利用docker搭建spark hadoop workbench

- 单机基于docker搭建hadoop2.7.1 spark1.7 高可用集群

- 单机Docker搭建Hadoop/Spark环境

- 在Docker上使用Weave搭建Hadoop和Spark跨主机容器集群

- 基于docker的spark-hadoop分布式集群之一: 环境搭建

- 大数据基础环境搭建的从spark到hadoop,从底层硬件到上层软件的一些必备注意事项

- 利用SpringCloud和Docker搭建普通互联网应用架构

- 基于docker搭建hadoop分布式集群(一)

- docker搭建hadoop分布式集群

- 利用Docker搭建gitlab

- 利用Docker搭建gitlab

- 四步利用docker搭建samba服务器

- ubuntu下利用docker搭建gitloab手记

- Mac OSX上利用Docker和Netbeans 搭建编译和开发 linux c/c++程序环境

- Ubuntu上搭建hadoop和spark集群

- 利用Docker搭建本地https环境的完整步骤

- 一步一步详细搭建Spark集群在docker上

- Docker-利用dockerfile来搭建tomcat服务

- 用Docker在一台笔记本电脑上搭建一个具有10个节点7种角色的Hadoop集群(下)-搭建Hadoop集群

- docker搭建hadoop