[机器学习]PCA(principal component analysis)

2017-11-27 17:23

351 查看

PCA(主成分分析)属于无监督学习的范畴,是一种降维方法。PCA选取包含信息量最多的方向对数据进行投影。

1. 推导PCA的2种方法(需回顾)

1)从重建误差最小化的角度

2)从方差最大化的角度

(详细推导见机器学习圣经 PRML )。

2. 求解方法

求解特征值和特征向量的方法分为 一般方法 和 使用技巧的方法

1)普通方法

直接 特征分解,求特征值和特征向量。

2)技巧--svd分解

3. 鲁棒PCA

我的硕士大论文回顾了相关研究。robust convex clustering论文用到了

1)robust pca

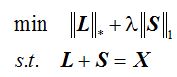

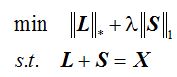

1.1) 从低秩的角度,主成份追踪(principal component pursuit,PCP)算法:

L 是一个低秩矩阵,S 是一个稀疏矩阵.

[2] Candès E J, Li X, Ma Y, et al. Robust principal component analysis?[J]. Journal of the ACM (JACM), 2011, 58(3): 11.

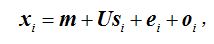

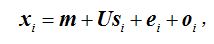

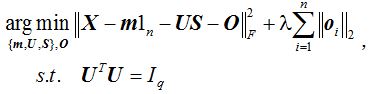

1.2) 从最小化重建误差的角度,在原始PCA基础上引入一个离群点矩阵O:

建模

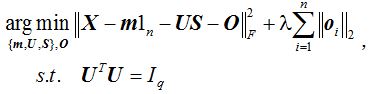

优化目标

向量m是所有样本的均值, U是投影矩阵, S是投影后的数据矩阵, E是偏差矩阵

我的 robust convex clustering也用了此种建模方法。

[3] Mateos G, Giannakis G B. Robust PCA as bilinear decomposition with outlier-sparsity regularization[J]. IEEE Transactions on Signal Processing, 2012, 60(10): 5176-5190.

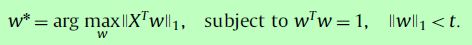

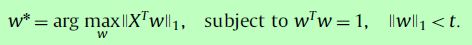

2)sparse robust pca

[4] Meng D, Zhao Q, Xu Z. Improve robustness of sparse PCA by L1-norm maximization[J]. Pattern Recognition, 2012, 45(1): 487-497.

4. 做过的实践 (需回顾)

模式分类课程实验-实验6

对ORL人脸数据集,用PCA进行分类(普通方法+svd方法),并与MDA方法、距离保持的降维法(DPDR)进行比较。

1. 推导PCA的2种方法(需回顾)

1)从重建误差最小化的角度

2)从方差最大化的角度

(详细推导见机器学习圣经 PRML )。

2. 求解方法

求解特征值和特征向量的方法分为 一般方法 和 使用技巧的方法

1)普通方法

直接 特征分解,求特征值和特征向量。

2)技巧--svd分解

3. 鲁棒PCA

我的硕士大论文回顾了相关研究。robust convex clustering论文用到了

1)robust pca

1.1) 从低秩的角度,主成份追踪(principal component pursuit,PCP)算法:

L 是一个低秩矩阵,S 是一个稀疏矩阵.

[2] Candès E J, Li X, Ma Y, et al. Robust principal component analysis?[J]. Journal of the ACM (JACM), 2011, 58(3): 11.

1.2) 从最小化重建误差的角度,在原始PCA基础上引入一个离群点矩阵O:

建模

优化目标

向量m是所有样本的均值, U是投影矩阵, S是投影后的数据矩阵, E是偏差矩阵

我的 robust convex clustering也用了此种建模方法。

[3] Mateos G, Giannakis G B. Robust PCA as bilinear decomposition with outlier-sparsity regularization[J]. IEEE Transactions on Signal Processing, 2012, 60(10): 5176-5190.

2)sparse robust pca

[4] Meng D, Zhao Q, Xu Z. Improve robustness of sparse PCA by L1-norm maximization[J]. Pattern Recognition, 2012, 45(1): 487-497.

4. 做过的实践 (需回顾)

模式分类课程实验-实验6

对ORL人脸数据集,用PCA进行分类(普通方法+svd方法),并与MDA方法、距离保持的降维法(DPDR)进行比较。

相关文章推荐

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——13、无监督学习:Principal Component Analysis (PCA)

- 降维算法(1):Principal Component Analysis(PCA)

- 主成分分析PCA(Principal Component Analysis)在sklearn中的应用及部分源码分析

- PCA(principal component analysis)

- 模式识别特征降维-PCA(Principal Component Analysis)

- Stanford 机器学习 Week8 作业:K-means Clustering and Principal Component Analysis

- PCA(Principal Component Analysis)主成分分析

- 彻底理解PCA(Principal Component Analysis)主成分分析

- SAS进行主成分分析(Principal Component Analysis,PCA)

- PCA(principal component analysis) 挖掘葡萄酒质量数据中的潜在变量

- Principal Component Analysis(PCA)

- 统计学习方法-主成分分析(Principal Component Analysis ,PCA )

- 特征降维-PCA(Principal Component Analysis)

- 矩阵应用:PCA-Principal Component Analysis

- Principal Component Analysis(PCA)

- PCA(Principal Component Analysis)主成分分析

- PCA,PrincipalComponentAnalysis

- 主成分分析PCA(Principal Component Analysis)介绍

- PCA(Principal Component Analysis)主成分分析

- 有关PCA(Principal Component Analysis)主成分分析/主累積寄与率元分析