24-hadoop-hiveserver2&jdbc

2017-08-17 19:39

369 查看

hive 可以 类似jdbc链接, 但启动的必须是hiveserver2, 才可以使用

或者

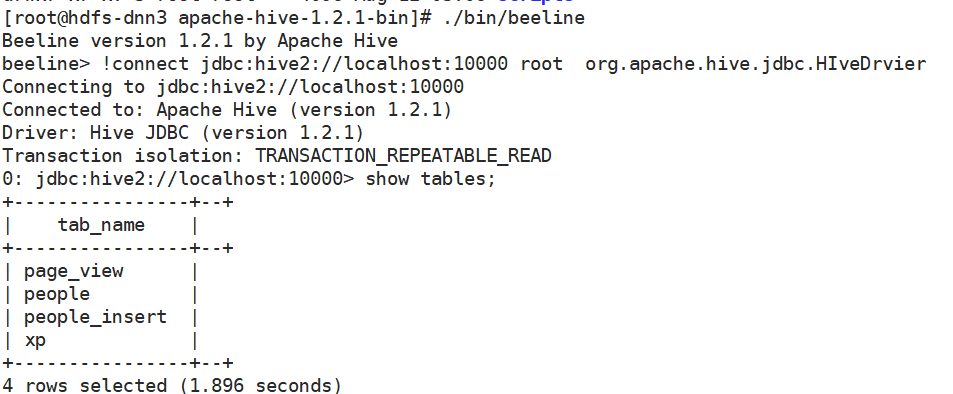

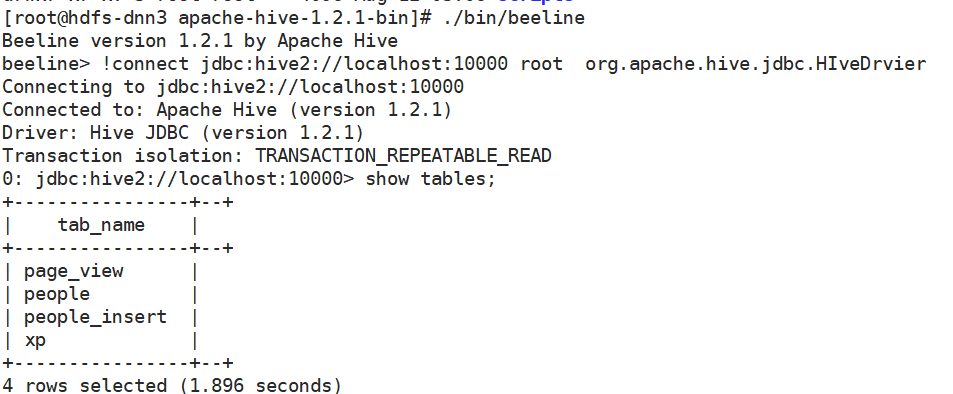

2, 使用 Beeline 进行连接

使用beeline链接, 和普通的hive是一样的, 只不过是远程的方式连接的, 操作命令几乎相同

因为密码为空, 所以不需要写

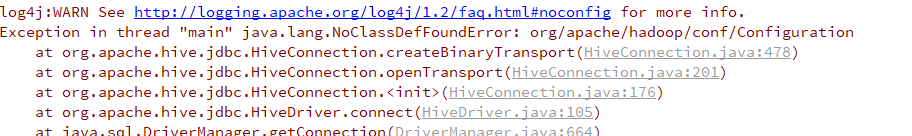

1, 导入jar包:

${HIVE_HOME}/lib下的所有包

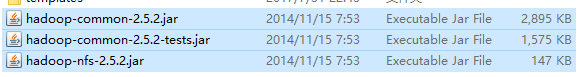

2, 导入hadoop的包, 否则报错

导入的包为:

${HADOOP_HOME}/share/hadoop/common/*

官网的例子坑太多了, python的链接没有实际操作, 改天试下并修改!!!!

然后链接:

hiveserver2

1, 启动:$HIVE_HOME/bin/hiveserver2

或者

$HIVE_HOME/bin/hive --service hiveserver2

2, 使用 Beeline 进行连接

beelin

使用beeline链接, 和普通的hive是一样的, 只不过是远程的方式连接的, 操作命令几乎相同

!connect jdbc:hive2://192.168.208.109:10000 username password org.apache.hive.jdbc.HIveDrvier

因为密码为空, 所以不需要写

!connect jdbc:hive2://localhost:10000 root org.apache.hive.jdbc.HIveDrvier

JDBC链接

java链接:1, 导入jar包:

${HIVE_HOME}/lib下的所有包

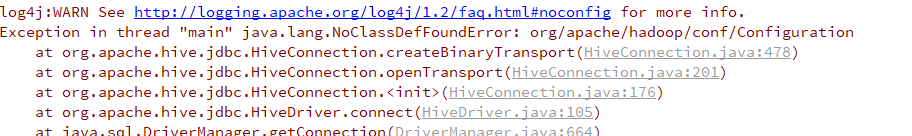

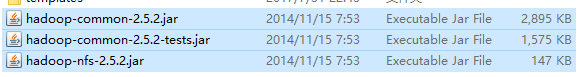

2, 导入hadoop的包, 否则报错

导入的包为:

${HADOOP_HOME}/share/hadoop/common/*

package com.wenbronk.hive;

import java.sql.*;

/**

*

*/

public class JDBCMain {

private static String driverName = "org.apache.hive.jdbc.HiveDriver";

public static void main(String[] args) throws SQLException {

try {

Class.forName(driverName);

Connection con = DriverManager.getConnection("jdbc:hive2://192.168.208.109:10000/default", "root", "");

String sql = "select * from people";

PreparedStatement state = con.prepareStatement(sql);

ResultSet res = state.executeQuery();

while (res.next()) {

System.out.println(res.getString(1) + "\t" + res.getString(2));

}

} catch (ClassNotFoundException e) {

e.printStackTrace();

System.exit(1);

}finally {

//close

}

}

}官网的例子坑太多了, python的链接没有实际操作, 改天试下并修改!!!!

python 链接

需要先安装包pip install pyhs2

然后链接:

import pyhs2

with pyhs2.connect(host='localhost',

port=10000,

authMechanism="PLAIN",

user='root',

password='',

database='default') as conn:

with conn.cursor() as cur:

#Show databases

print cur.getDatabases()

#Execute query

cur.execute("select * from table")

#Return column info from query

print cur.getSchema()

#Fetch table results

for i in cur.fetch():

print i

相关文章推荐

- hiveserver2&&beeline&&java client

- Java 连接hive2 server 通过jdbc 出现了问题 Required field 'client_protocol' is unset! Struct:TOpenSessionReq

- hadoop组件---数据仓库(五)---通过JDBC连接hive的thrift或者hiveserver2

- ubuntu16.04+hadoop2.7.2+hive1.2.1 server2通过jdbc连接

- hadoop&hive优化

- "com.microsoft.jdbc.sqlserver.SQLServerDriver";

- 谈JDBC SQLSERVER"Error establishing socket

- com.microsoft.sqlserver.jdbc.SQLServerException: 对象名 'xxxxx' 无效

- HiveServer2 JDBC客户端连接Hive数据库

- hadoop(1):centos 安装 hadoop & hive

- hadoop & hive任务优化之map个数的影响因子

- HiveServer2中使用jdbc访问hbase时导致ZooKeeper连接持续增加的解决

- Hadoop&hive安装配置

- 解决hiveserver2报错:java.io.IOException: Job status not available - Error while processing statement: FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.mr.MapRedTask

- Win7中使用Eclipse连接虚拟机中的Ubuntu中的Hadoop2.4<2>

- Hadoop Hive概念学习系列之hive三种方式区别和搭建、HiveServer2环境搭建、HWI环境搭建和beeline环境搭建(五)

- Hadoop Hive概念学习系列之hive里的扩展接口(CLI、Beeline、JDBC)(十六)

- Start hadoop, hive, hue server in the virtual hadoop clusters based on docker

- Why Should HBase RegionServer & Hadoop DataNode Colocate?

- HiveServer2 JDBC客户端连接Hive数据库