随机梯度下降和批量梯度下降的区别

2017-06-29 09:46

295 查看

最近,看了斯坦福大学讲的梯度下降算法的视频,对其中的批量梯度下降算法(batch gradient descent algorithm,BGD)和随机梯度下降算法(Stochastic gradient descent algorithm,SGD)的区别还是不太理解。在网上查了一下,给出自己的理解:

样本个数为m,x为n维的向量。

(1)批量梯度下降:

权值更新公式:

从公式中可以看出,批量梯度下降算法每迭代一步,要用到训练集的所有样本,最后得到的是一个全局最优解。

(2)随机梯度下降:

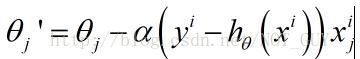

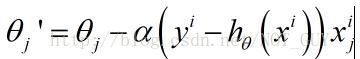

权值更新公式:

也是看公式,能够发现随机梯度的权值更新公式里调整项没有累加符号,说明随机梯度下降中只用到了训练集的一个样本,最后得到的可能是全局最优解,也可能是局部最优解。

样本个数为m,x为n维的向量。

(1)批量梯度下降:

权值更新公式:

从公式中可以看出,批量梯度下降算法每迭代一步,要用到训练集的所有样本,最后得到的是一个全局最优解。

(2)随机梯度下降:

权值更新公式:

也是看公式,能够发现随机梯度的权值更新公式里调整项没有累加符号,说明随机梯度下降中只用到了训练集的一个样本,最后得到的可能是全局最优解,也可能是局部最优解。

相关文章推荐

- 随机梯度下降和批量梯度下降的原理和区别

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 梯度下降、随机梯度下降和批量梯度下降

- 随机梯度下降和批量梯度下降的简单代码实现

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- online learning,batch learning&批量梯度下降,随机梯度下降

- 梯度下降、随机梯度下降(SGD)、批量梯度下降(BGD)的对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 批量梯度下降与随机梯度下降

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )

- 随机梯度下降,批量梯度下降,牛顿法,拟牛顿法

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 随机梯度下降和批量梯度下降

- 梯度下降与随机梯度下降的区别