【深度学习论文】ResNet

2017-06-26 18:33

645 查看

ResNet导读

深度神经网络不是越深越好

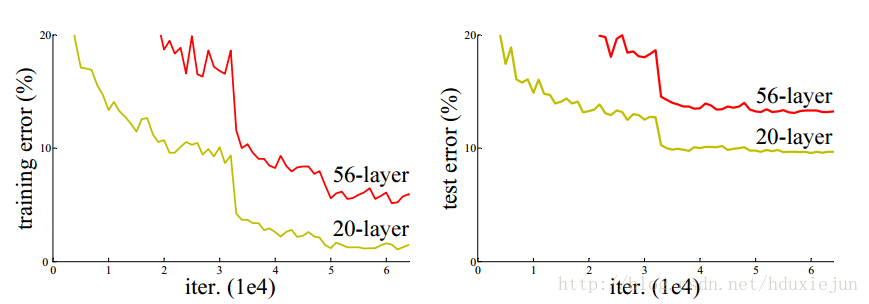

当深度神经网络特别深的时候,识别的错误率反而可能更高,如论文中所示,56层的神经网络识别的训练和测试阶段的错误率反而比20层的要高。

改造VGG19

基本Block

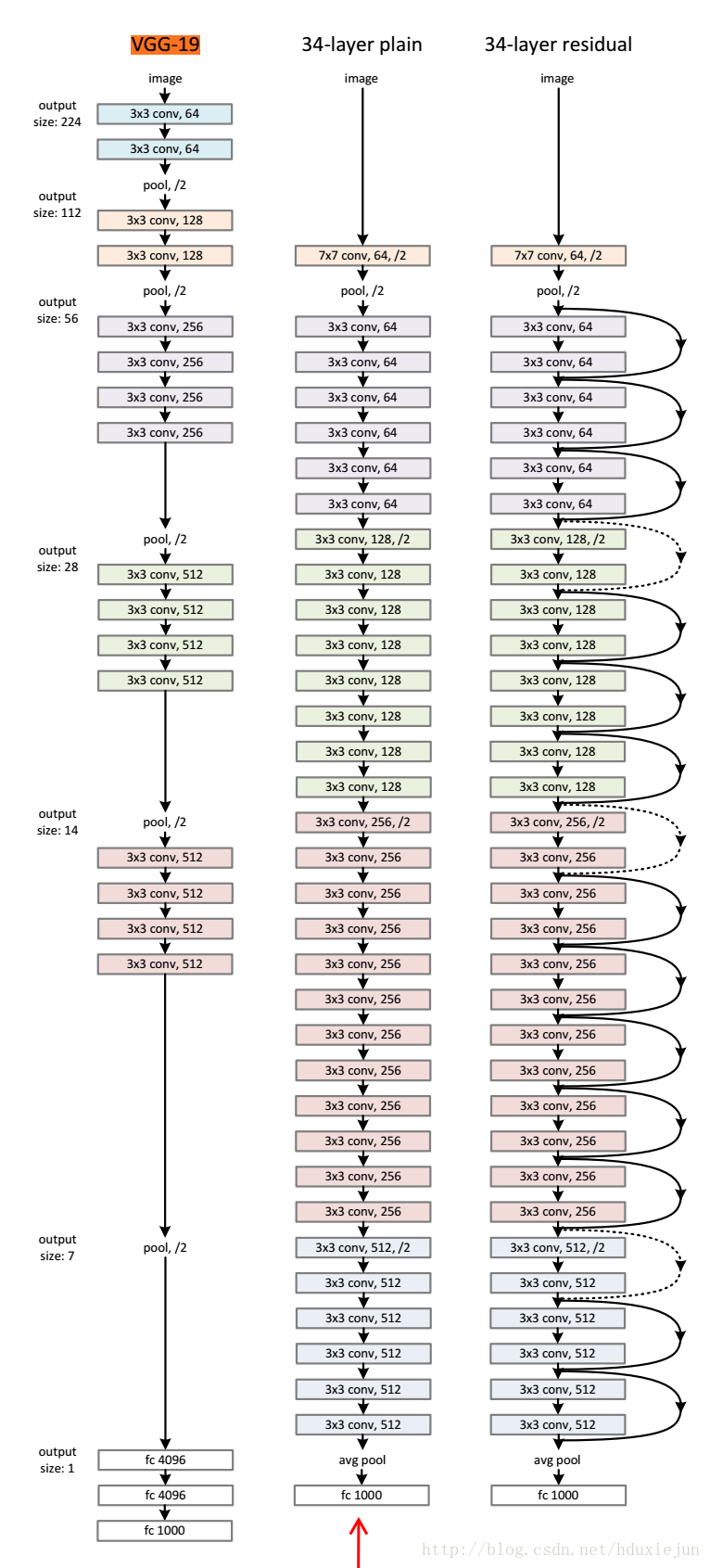

如上图所示,分别为VGG-19,34层返照VGG的结构,加入block之后结构。

最重要的公式

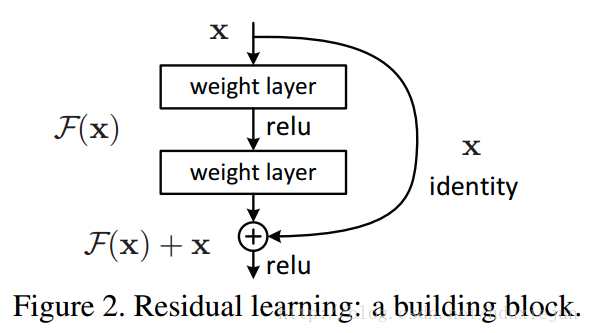

Block如上图所示,是将输入之前的神经网络和经过两个卷积的神经网络进行了相加。

其计算公式如上图所示,其中Ws是用来调节维度用。

对比实验结果

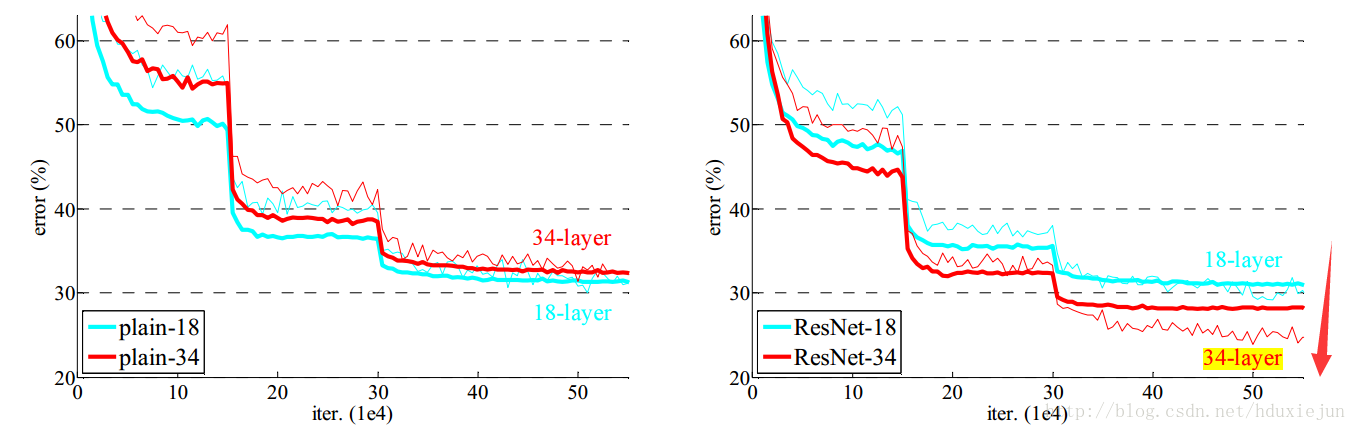

可以看到上图右图中加入block的深度残差网络效果明显提升。

相关文章推荐

- 深度学习论文随记(四)ResNet 残差网络-2015年Deep Residual Learning for Image Recognition

- 近期深度学习论文汇总

- 深度学习论文阅读笔记--Deep Learning Face Representation from Predicting 10,000 Classes

- 【深度学习经典论文翻译1】AlexNet-ImageNet Classification with Deep Convolutional Neural Networks全文翻译

- 深度学习论文笔记:OverFeat

- 【深度学习经典论文翻译2】GoogLeNet-Going Deeper with Convolutions全文翻译

- 论文阅读(2013-1)----深度学习的昨天,今天和明天

- 深度学习有哪些好玩的且易于实现的论文?

- 新智元:【arXiv】2015 深度学习年度十大论文

- 【arXiv】2015 深度学习年度十大论文

- 计算机视觉和深度学习领域引用次数最多的论文

- 深度学习论文笔记--Recover Canonical-View Faces in the Wild with Deep Neural Network

- 深度学习论文笔记-Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition

- 深度学习论文理解3:Flexible, high performance convolutional neural networks for image classification

- 深度学习入门必看的书和论文?有哪些必备的技能需学习?

- Hinton 深度学习论文总结

- 深度学习论文理解2:on random weights and unsupervised feature learning

- 深度学习论文笔记--Depth Map Prediction from a Single Image using a Multi-Scale Deep Network

- 深度学习文字识别论文综述

- 全球30篇最热门的计算机视觉和深度学习论文