神经网络激活函数--tanh双曲正切函数

2017-03-04 16:11

666 查看

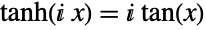

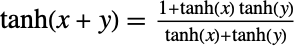

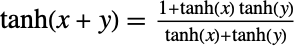

Tanh 是双曲正切函数,是三角学中普遍使用的

Tan 圆函数的双曲类比.

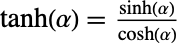

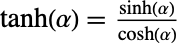

Tanh[α] 定义为对应的双曲正弦和双曲余弦函数的比值,即

via

.

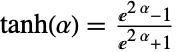

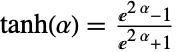

Tanh 也可以定义为

,其中

是自然对数

Log 的底数.

当变量是有理数的(自然)对数时,Tanh 会自动计算出精确值. 当给出精确数值表达式作为变量时,Tanh

可以算出任意精度的数值结果. TrigFactorList 可将包含

Tanh 的表达式因式分解为包含

Sinh、Cosh、Sin

和 Cos 的单项式. 对包含

Tanh 的符号表达式,其他适用的操作运算有

TrigToExp、TrigExpand、Simplify

和 FullSimplify.

Tanh 自动逐项作用于列表和矩阵. 相比之下,MatrixFunction

则可用于给出整个方阵的双曲正切值(即用矩阵幂次代替普通幂次的双曲正切函数的幂级数)而不是单个矩阵元素的双曲正切值.

对小的负的

x 值 Tanh[x]

趋向于

而对大的正的

x 值则趋向于

.

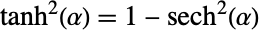

Tanh 和

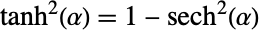

Tan 类似,也满足勾股恒等式,即

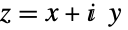

. 双曲正切函数的定义可由等式

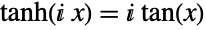

和

扩展到复数变量

上.

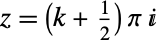

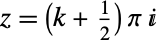

Tanh 在

且

是整数的这些点处取得极值

ComplexInfinity.

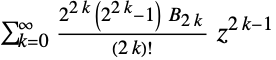

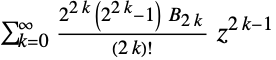

Tanh[z] 在原点处的级数展开为

,可由伯努利数

BernoulliB 构成的项表示.

Tanh 的反函数是

ArcTanh. 其他相关的数学函数有

Sinh、Coth 和

Tan.

Tan 圆函数的双曲类比.

Tanh[α] 定义为对应的双曲正弦和双曲余弦函数的比值,即

via

.

Tanh 也可以定义为

,其中

是自然对数

Log 的底数.

当变量是有理数的(自然)对数时,Tanh 会自动计算出精确值. 当给出精确数值表达式作为变量时,Tanh

可以算出任意精度的数值结果. TrigFactorList 可将包含

Tanh 的表达式因式分解为包含

Sinh、Cosh、Sin

和 Cos 的单项式. 对包含

Tanh 的符号表达式,其他适用的操作运算有

TrigToExp、TrigExpand、Simplify

和 FullSimplify.

Tanh 自动逐项作用于列表和矩阵. 相比之下,MatrixFunction

则可用于给出整个方阵的双曲正切值(即用矩阵幂次代替普通幂次的双曲正切函数的幂级数)而不是单个矩阵元素的双曲正切值.

对小的负的

x 值 Tanh[x]

趋向于

而对大的正的

x 值则趋向于

.

Tanh 和

Tan 类似,也满足勾股恒等式,即

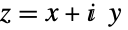

. 双曲正切函数的定义可由等式

和

扩展到复数变量

上.

Tanh 在

且

是整数的这些点处取得极值

ComplexInfinity.

Tanh[z] 在原点处的级数展开为

,可由伯努利数

BernoulliB 构成的项表示.

Tanh 的反函数是

ArcTanh. 其他相关的数学函数有

Sinh、Coth 和

Tan.

Tanh[2.2] Out[1]=

相关文章推荐

- 机器学习笔记-神经网络中激活函数(activation function)对比--Sigmoid、ReLu,tanh

- python绘制神经网络中的Sigmoid和Tanh激活函数图像(附代码)

- 【机器学习】神经网络-激活函数-面面观(Activation Function) (Sigmoid Relu tanh)

- 神经网络中的激活函数tanh sigmoid RELU softplus softmatx

- 神经网络之激活函数(sigmoid、tanh、ReLU)

- 神经网络中的激活函数——加入一些非线性的激活函数,整个网络中就引入了非线性部分,sigmoid 和 tanh作为激活函数的话,一定要注意一定要对 input 进行归一话,但是 ReLU 并不需要输入归一化

- 神经网络中的激活函数(activation function)-Sigmoid, ReLu, TanHyperbolic(tanh), softmax, softplus

- 神经网络中的激活函数-Sigmoid, ReLu, TanHyperbolic(tanh), softmax, softplus简述

- CS231n课程笔记5.1:神经网络历史&激活函数比较

- [转]神经网络-激活函数

- 神经网络五:常用的激活函数

- [置顶] 【机器学习】神经网络-激活函数-面面观(Activation Function)

- 神经网络与深度学习之激活函数

- 神经网络学习笔记 - 激活函数的作用、定义和微分证明

- 神经网络-激活函数-面面观(Activation Function)

- 【机器学习】神经网络-激活函数-面面观(Activation Function)

- 神经网络之激活函数(Activation Function)(附maxout)

- 神经网络激活函数与损失函数

- 神经网络之激活函数面面观

- 神经网络激活函数及导数