[Spark]Spark Streaming 指南三 DStreams

2017-03-01 20:17

197 查看

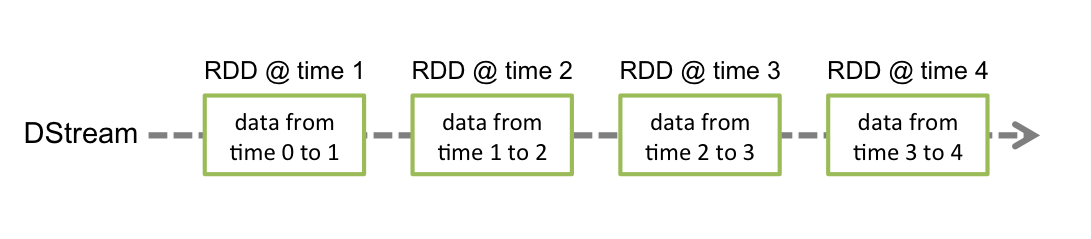

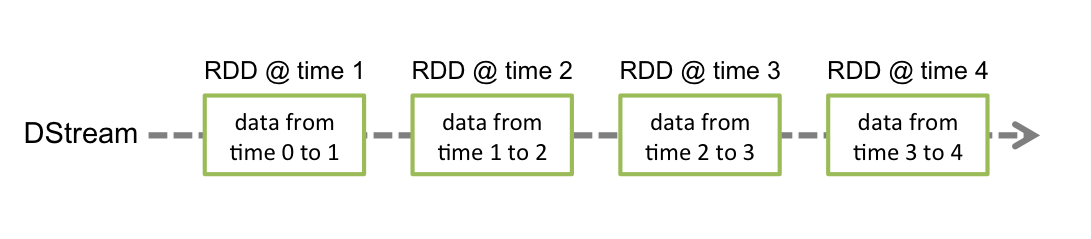

离散流或者DStreams是Spark Streaming提供的基本抽象,它代表一个连续的数据流。从源中获取输入流,或者是输入流通过转换算子生成的处理后的数据流。在内部,DStreams由一系列连续的 RDD组成。这是Spark对不可变,分布式数据集的抽象(更多细节参见Spark编程指南)。 DStream中的每个RDD包含来自特定间隔的数据,如下图所示:

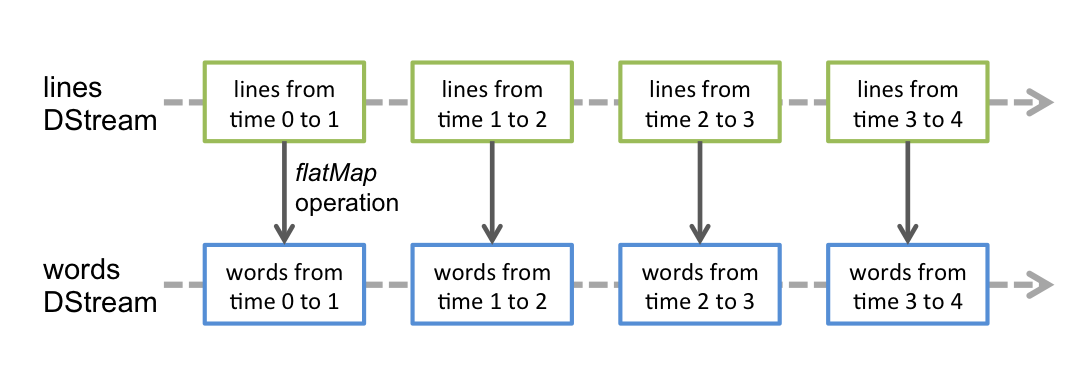

对DStream应用的任何操作都会转换为DStream隐含的RDD的操作。 例如,在指南一示例将行数据流转换单词数据流例子中,flatMap操作应用于lines这个DStreams的每个RDD,生成words这个DStreams的 RDD。过程如下图所示:

这些隐含RDD转换操作由Spark引擎计算。 DStream操作隐藏了大部分细节,并为开发人员提供了更高级别的API以方便使用。 这些操作将在后面的章节中详细讨论。

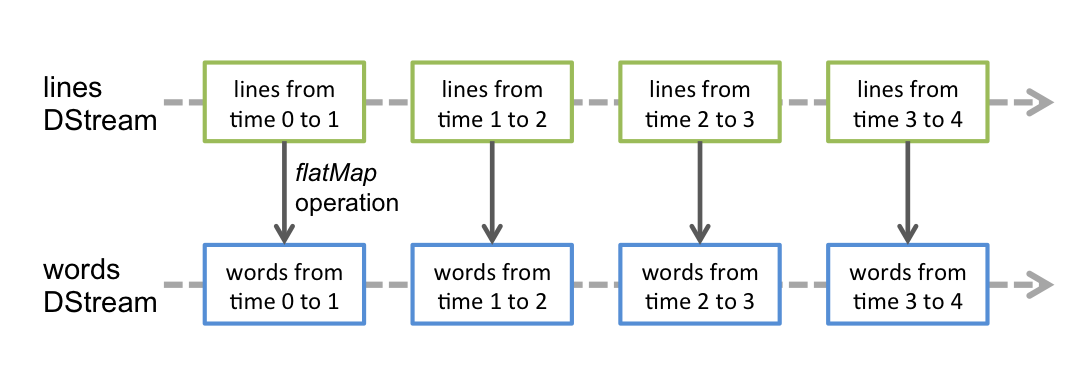

对DStream应用的任何操作都会转换为DStream隐含的RDD的操作。 例如,在指南一示例将行数据流转换单词数据流例子中,flatMap操作应用于lines这个DStreams的每个RDD,生成words这个DStreams的 RDD。过程如下图所示:

这些隐含RDD转换操作由Spark引擎计算。 DStream操作隐藏了大部分细节,并为开发人员提供了更高级别的API以方便使用。 这些操作将在后面的章节中详细讨论。

相关文章推荐

- [Spark]Spark Streaming 指南四 输入DStreams和Receivers

- Spark2.1.0文档:Spark Streaming 编程指南(下)-性能调优和容错语义

- Spark Streaming编程指南(一)

- 【转】Spark Streaming和Kafka整合开发指南

- Spark Streaming编程指南(二)

- Spark Streaming编程指南(三)

- Spark之SparkStreaming-Input DStreams and Receivers

- Apache Spark 2.2.0 中文文档 - Spark Streaming 编程指南 | ApacheCN

- Spark Streaming编程指南(四)

- spark-streaming-[7]-Output Operations on DStreams-foreachRDD写Mysql

- [Spark]Spark Streaming 指南一 Example

- Apache Spark 2.2.0 中文文档 - Spark Streaming 编程指南 | ApacheCN

- Spark Streaming编程指南(部分)

- spark官方文档之——Spark Streaming Programming Guid spark streaming编程指南

- Spark Structured Streaming入门编程指南

- [Spark]Spark Streaming 指南二 初始化StreamingContext

- Apache Spark 2.2.0 中文文档 - Spark Streaming 编程指南 | ApacheCN

- Spark Streaming 编程指南-Spark2.0(官方文档)

- spark streaming 异常No output streams registered, so nothing to execute

- Spark Streaming-1:Spark Streaming编程指南