HDFS学习笔记

2016-09-22 16:36

316 查看

HDFS简介

1.兼容廉价的硬件设备

2.流数据读写

3.大数据集

4.简单的文件模型

5.强大的跨平台兼容性

块

HDFS采用抽象的块概念可以带来以下几个明显的好处:

1.支持大规模文件存储:文件以块为单位进行存储,一个大规模文件可以被分拆成若干个文件块,不同的文件块可以被分发到不同的节点上,因此

,一个文件的大小不会受到单个节点的存储容量的限制,可以远远大于网络中任意节点的存储容量

2.简化系统设计:首先,大大简化了存储管理,因为文件块大小是固定的,这样就可以很容易计算出一个节点可以存储多少文件块;其次,方便了

元数据的管理,元数据不需要和文件块一起存储,可以由其他系统负责管理元数据

3.适合数据备份:每个文件块都可以冗余存储到多个节点上,大大提高了系统的容错性和可用性

NameNode

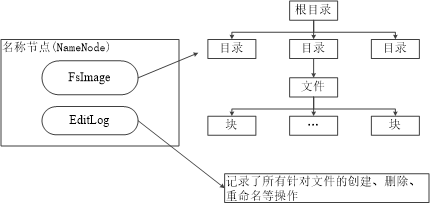

名称节点(NameNode)负责管理分布式文件系统的命名空间(Namespace),保存了两个核心的数据结构,即FsImage和EditLog。FsImage用于维护文件系统树以及文件树中所有的文件和文件夹的元数据,操作日志文件EditLog中记录了所有针对文件的创建、删除、重命名等操作。

FsImage文件

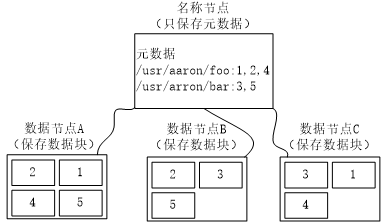

FsImage文件中包含文件系统中所有目录和文件inode的序列化形式。每个inode是一个文件或目录的元数据的内部表示,并包含此类信息:文件的复制等级、修改和访问时间、访问权限、块大小以及组成文件的块。对于目录,则存储修改时间、权限和配额元数据FsImage文件没有记录块存储在哪个数据节点。而是由名称节点把这些映射保留在内存中,当数据节点加入HDFS集群时,数据节点会把自己所包含的块列表告知给名称节点,此后会定期执行这种告知操作,以确保名称节点的块映射是最新的。

NameNode启动

1)NameNode启动的时候,首先将FsImage文件中的内容加载到内存中,之后再执行EditLog文件中的各项操作,使得内存中的元数据和实际的同步,存在内存中的元数据支持客户端的读操作。

2)一旦在内存中成功建立文件系统元数据的映射,则创建一个新的FsImage文件和一个空的EditLog文件。

3)名称节点起来之后,HDFS中的更新操作会重新写到EditLog文件中,因为FsImage文件一般都很大(GB级别的很常见),如果所有的更新操

作都往FsImage文件中添加,这样会导致系统运行的十分缓慢,但是,如果往EditLog文件里面写就不会这样,因为EditLog 要小很多。每次执行

写操作之后,且在向客户端发送成功代码之前,edits文件都需要同步更新。

SecondaryNameNode

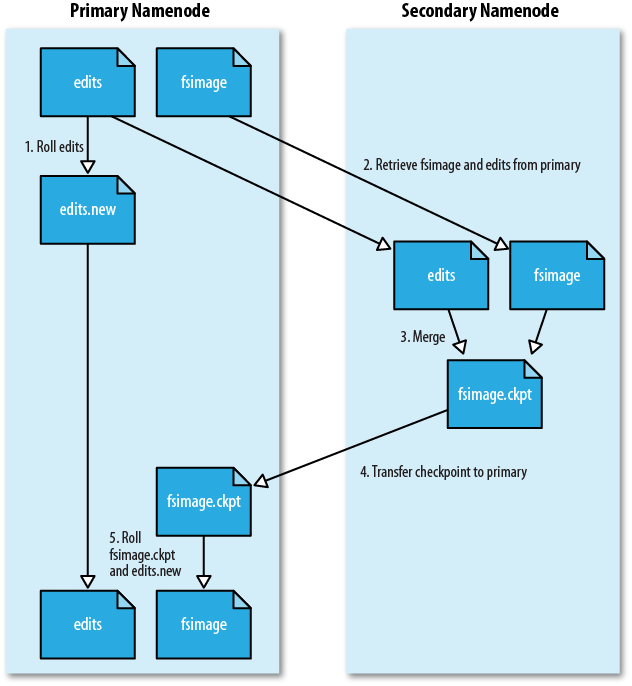

名称节点运行的过程中,随着操作的增加,EditLog文件会不断的增大,当EditLog变得非常大的时候,会导致名称节点启动操作非常慢。利用第二名称节点来解决这个问题,另外第二名称节点还可以作为冷备份。SecondaryNameNode工作情况:

(1)SecondaryNameNode会定期和NameNode通信,请求其停止使用EditLog文件,暂时将新的写操作写到一个新的文件edit.new上来,这个操作是瞬间完成,上层写日志的函数完全感觉不到差别;

(2)SecondaryNameNode通过HTTP GET方式从NameNode上获取到FsImage和EditLog文件,并下载到本地的相应目录下;

(3)SecondaryNameNode将下载下来的FsImage载入到内存,然后一条一条地执行EditLog文件中的各项更新操作,使得内存中的FsImage保持最新;这个过程就是EditLog和FsImage文件合并;

(4)SecondaryNameNode执行完(3)操作之后,会通过post方式将新的FsImage文件发送到NameNode节点上

(5)NameNode将从SecondaryNameNode接收到的新的FsImage替换旧的FsImage文件,同时将edit.new替换EditLog文件,通过这个过程EditLog就变小了

DataNode

数据节点是分布式文件系统HDFS的工作节点,负责数据的存储和读取,会根据客户端或者是名称节点的调度来进行数据的存储和检索,并且向名称节点定期发送自己所存储的块的列表。每个数据节点中的数据会被保存在各自节点的本地Linux文件系统中

HDFS存储原理

冗余数据保存

作为一个分布式文件系统,为了保证系统的容错性和可用性,HDFS采用多副本的方案对数据进行冗余存储。通常一个数据块会被分布到不同的数据节点上。这样做的优点:1>加快了数据传输速度;2>容易检查数据错误;3>保证数据的可靠性。

数据出错与恢复

1>名称节点出错名称节点保存着最核心的连个文件FsImage和EditLog,当这两个文件损坏,那么整个文件系统都将失效。因此,HDFS设置了备份机制,通过SecondaryNameNode上的FsImage和EditLog来进行数据恢复。

2>数据节点出错

每个数据节点会定期的想名称节点发送心跳,当网络或者数据节点出现故障时,名称节点就无法接收到心跳信息。那么将把没有心跳信息的节点标记为“宕机”,对应节点上的所有信息都会标记为“不可读”,这样就导致一些数据块副本数量小于冗余因子。名称节点会定期的检查每个副本的冗余情况,一旦发现某个文件的副本数量小于冗余因子,就会启动数据冗余复制生成新的副本。

3>数据出错

文件被创建的时候,客户端就会对每一个文件进行信息摘录,并把这些信息写入同一路径下的隐藏文件夹下面。当客户端读取到数据后,会对每一个文件快进行MD5和sha1校验。如果校验出错,就会请求读取其他节点的同一数据块,并向名称节点报告这个文件有错误,名称节点会定期的检查并且重新复制这个块。

HDFS读写

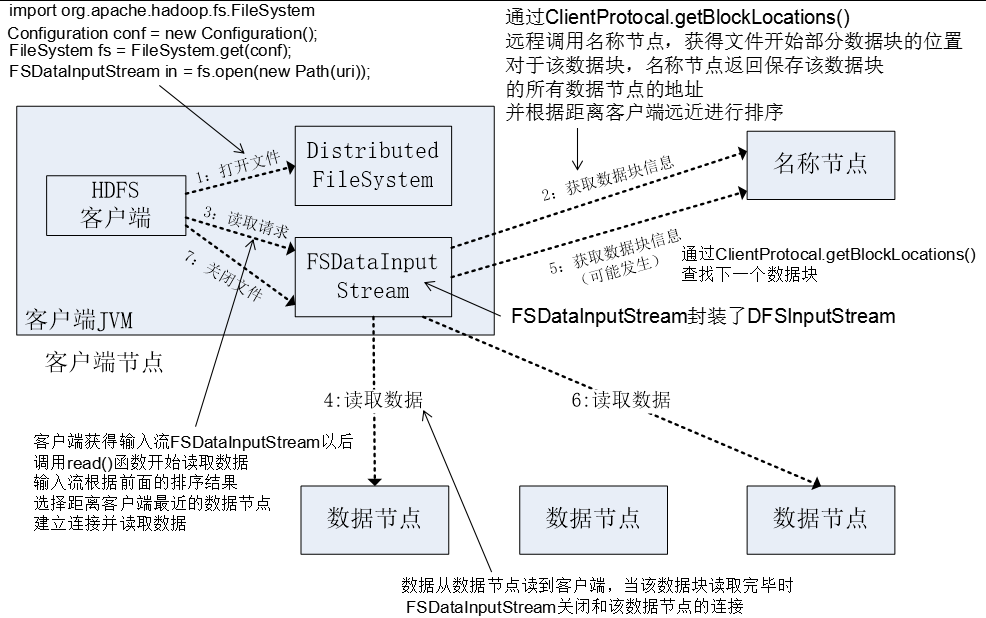

HDFS读取

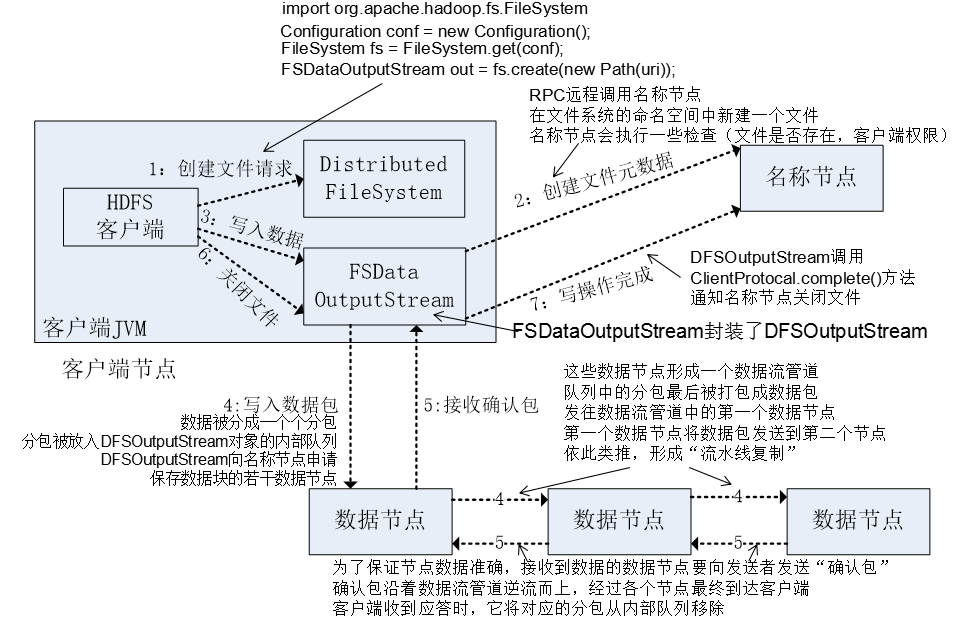

HDFS写入

相关文章推荐

- hadoop学习笔记(10)-HDFS I/O性能测试

- Hadoop学习笔记之---HDFS

- hadoop学习笔记-HDFS原理

- Hadoop 学习笔记(一) HDFS API

- 【hadoop】Hadoop学习笔记(五):一些关于HDFS的基本知识

- Hadoop学习笔记(五):一些关于HDFS的基本知识

- Hadoop HDFS源码学习笔记(二)

- Hadoop学习笔记之六:HDFS功能逻辑(2)

- Hadoop学习笔记—2.不怕故障的海量存储:HDFS基础入门

- HDFS学习笔记

- hadoop学习笔记-基于hdfs搭建简单网盘应用

- 云计算学习笔记004---hadoop的简介,以及安装,用命令实现对hdfs系统进行文件的上传下载

- hadoop学习笔记<三>----HDFS

- Hadoop学习笔记之四:HDFS客户端

- 云计算学习笔记005---Hadoop HDFS和MapReduce 架构浅析

- 高可用性的HDFS学习笔记1

- 安装、进程-云计算学习笔记---hadoop的简介,以及安装,用命令实现对hdfs系统进行文件的上传下载-by小雨

- Hadoop HDFS源码学习笔记(六)--fetchBlockByteRange

- Hadoop学习笔记---HDFS简介

- hadoop学习笔记-HDFS原理