分类

2016-07-28 10:14

232 查看

从概率的角度讲,以分类为例,机器学习的目的是从训练数据中学习并估计后验概率P(c|X),其中X表示训练数据集,c表示预测的类别。如果直接对P(c|X)的值进行估计,而不考虑训练数据所服从的分布,这种方法产生的模型为判别模型。从这个角度讲,线性判别模型(如logistics回归)、SVM、多层网络都属于判别模型。相反,如果对P(c|X)的值进行估计的过程中考虑了数据所服从的分布,如假设P(X)、P(X,Y)或其他变量服从某种分布,那么将会得到生成模型,如贝叶斯分类模型。

对于生成模型来说,当假设了数据变量服从某种概率分布时,概率分布模型的学习过程变成了参数估计过程。

166bc

最大的Y的取值,即为数据X所属的类别标签cj.

后验概率p(Y=cj|X)是通过贝叶斯公式计算的,如下

p(Y=cj|X)=p(X|Y=cj)p(Y=cj)∑jp(X|Y=cj)p(Y=cj)

其中,p(X|Y=cj)中每个数据X=(x1,x2,...,xm)包含m个特征,如果假设这些特征是在Y=cj条件下是相互独立的,那么p(X|Y=cj)=∏ip(xi|Y=cj),这也是朴素贝叶斯之所以朴素的地方,即在已知分类类别的情况下,假设各个特征之间是条件独立的。

上述可以根据拉格朗日对偶性转化为极大极小问题。

最大熵模型与Logistics模型

两者均属于对数线性模型,一般使用极大似然估计学习模型中的参数。两者也均可形式化为无约束最优化问题,从而使用梯度下降、牛顿法等求解。

最大熵模型是多分类的Logistics模型。详见这里

最大熵分类与朴素贝叶斯分类

都是求给定输入X的情况下,求其类别Y所服从的分布。

1.http://www.cs.cmu.edu/afs/cs/user/aberger/www/html/tutorial/tutorial.html

最大熵模型与Logistics 模型的关系

1. https://www.quora.com/What-is-the-relationship-between-Log-Linear-model-MaxEnt-model-and-Logistic-Regression#

2. Mount J. The equivalence of logistic regression and maximum entropy models[J]. URL: http://www. win-vector. com/dfiles/LogisticRegressionMaxEnt. pdf, 2011.

3. http://www.win-vector.com/blog/2011/09/the-equivalence-of-logistic-regression-and-maximum-entropy-models/

对于生成模型来说,当假设了数据变量服从某种概率分布时,概率分布模型的学习过程变成了参数估计过程。

广义线性模型

一般线性回归

logistic回归

对p(Y|X)和X之间的关系建模。朴素贝叶斯分类

朴素贝叶斯分类的主要思想是:对于待分类数据X=(x1,x2,...,xm),计算使后验概率p(Y=cj|X)166bc

最大的Y的取值,即为数据X所属的类别标签cj.

后验概率p(Y=cj|X)是通过贝叶斯公式计算的,如下

p(Y=cj|X)=p(X|Y=cj)p(Y=cj)∑jp(X|Y=cj)p(Y=cj)

其中,p(X|Y=cj)中每个数据X=(x1,x2,...,xm)包含m个特征,如果假设这些特征是在Y=cj条件下是相互独立的,那么p(X|Y=cj)=∏ip(xi|Y=cj),这也是朴素贝叶斯之所以朴素的地方,即在已知分类类别的情况下,假设各个特征之间是条件独立的。

最大熵分类

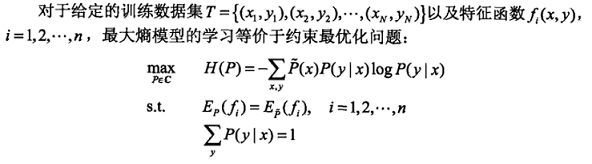

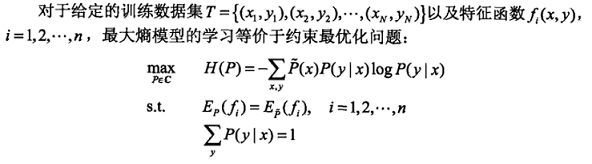

最大熵分类的原理是对于待分类数据X,求输出类别Y所服从的分布,根据该分布自然可以得到X所属类别。该分布满足的条件是使p(Y|X)的条件熵最大。通常,对给定X时,Y服从的分布有一定的限制,这些限制作为问题求解的约束条件。所以最大熵模型为求解如下带约束条件的最大条件熵问题:

上述可以根据拉格朗日对偶性转化为极大极小问题。

最大熵模型与Logistics模型

两者均属于对数线性模型,一般使用极大似然估计学习模型中的参数。两者也均可形式化为无约束最优化问题,从而使用梯度下降、牛顿法等求解。

最大熵模型是多分类的Logistics模型。详见这里

最大熵分类与朴素贝叶斯分类

都是求给定输入X的情况下,求其类别Y所服从的分布。

参考

最大熵模型1.http://www.cs.cmu.edu/afs/cs/user/aberger/www/html/tutorial/tutorial.html

最大熵模型与Logistics 模型的关系

1. https://www.quora.com/What-is-the-relationship-between-Log-Linear-model-MaxEnt-model-and-Logistic-Regression#

2. Mount J. The equivalence of logistic regression and maximum entropy models[J]. URL: http://www. win-vector. com/dfiles/LogisticRegressionMaxEnt. pdf, 2011.

3. http://www.win-vector.com/blog/2011/09/the-equivalence-of-logistic-regression-and-maximum-entropy-models/

相关文章推荐

- 朴素贝叶斯分类

- 朴素贝叶斯算法原理解析及代码实现

- 朴素贝叶斯要点

- 很少训练数据情况下的模型性能对比

- 分类问题之朴素贝叶斯模型

- 机器学习算法解析—朴素贝叶斯分类

- 朴素贝叶斯的JAVA实现

- 朴素贝叶斯

- 数据挖掘算法逻辑回归-R实现

- 机器学习--logistic回归和softmax回归

- Python实现朴素贝叶斯分类器

- Logistic回归

- 朴素贝叶斯的实际应用

- 基于朴素贝叶斯的关于互联网金融新闻分类(python实现)

- 机器学习实战朴素贝叶斯的java实现

- 贝叶斯分类

- 判别模型(Discriminative model)和生成模型(Generative model)

- 几种分类方法简述

- 朴素贝叶斯--matlab自带工具箱的使用

- 统计学习方法---朴素贝叶斯法