Spark Transformation —— distinct 算子

2016-07-22 10:45

561 查看

distinct

对RDD中的元素进行去重操作。代码测试

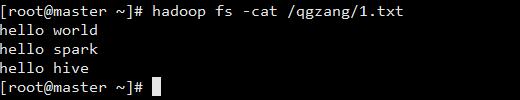

测试数据准备

在hdfs上放一个文件1.txt

打开spark-shell

spark-shell --master spark://master:7077(重要的事情说多遍,spark-shell和spark-submit核心的参数是差不多的)

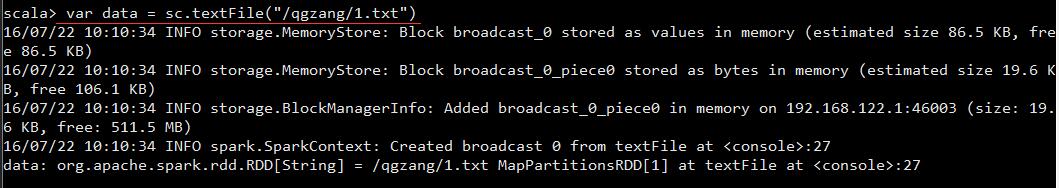

创建RDD

var data = sc.textFile("/qgzang/1.txt")

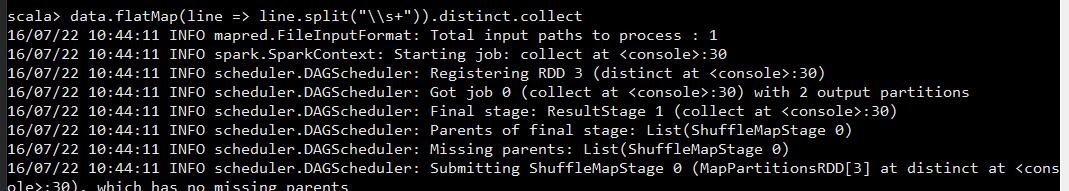

测试distinct 算子

scala> data.flatMap(line => line.split("\\s+")).collect

res61: Array[String] = Array(hello, world, hello, spark, hello, hive, hi, spark)

scala> data.flatMap(line => line.split("\\s+")).distinct.collect

res62: Array[String] = Array(hive, hello, world, spark, hi)

相关文章推荐

- Spark RDD API详解(一) Map和Reduce

- 使用spark和spark mllib进行股票预测

- Spark随谈——开发指南(译)

- Spark,一种快速数据分析替代方案

- 针对distinct疑问引发的一系列思考

- distinct 多列问题结合group by的解决方法

- 为何Linq的Distinct实在是不给力

- oracle sql 去重复记录不用distinct如何实现

- 解析mysql中:单表distinct、多表group by查询去除重复记录

- sqlserver中distinct的用法(不重复的记录)

- MySQL中distinct与group by之间的性能进行比较

- MySQL中distinct和count(*)的使用方法比较

- MySQL中Distinct和Group By语句的基本使用教程

- MySQL中distinct语句去查询重复记录及相关的性能讨论

- oracle中使用group by优化distinct

- oracle中distinct的用法详解

- SQL中distinct的用法(四种示例分析)

- MySQL中distinct与group by语句的一些比较及用法讲解

- MySQL中索引优化distinct语句及distinct的多字段操作

- Mongodb聚合函数count、distinct、group如何实现数据聚合操作