hadoop架构详解一

2016-03-29 00:00

411 查看

摘要: hadoop架构详解

hadoop架构组成

hadoop有两部分组成:分布式文件系统HDFS,统一的资源管理器YARN

hdfs架构

Client:切分文件;访问或通过命令行管理HDFS;与NameNode交互,获取文件位置信息;与DataNode交互,读取和写入数据。

NameNode:Master节点,只有一个,管理HDFS的名称空间和数据块映射信息;配置副本策略;处理客户端请求。

DataNode:Slave节点,存储实际的数据;执行数据块的读写;汇报存储信息给NameNode。

Secondary NameNode:辅助NameNode,分担其工作量;定期合并fsimage和fsedits,推送给NameNode;紧急情况下,可辅助恢复NameNode,但Secondary NameNode并非NameNode的热备。

fsimage和fsedits

NameNode中两个很重要的文件,

fsimage是元数据镜像文件(保存文件系统的目录树)。

edits是元数据操作日志(记录每次保存fsimage之后到下次保存之间的所有hdfs操作)。

fsimage文件其实是Hadoop文件系统元数据的一个永久性的检查点,其中包含Hadoop文件系统中的所有目录和文件idnode的序列化信息;

edits文件存放的是Hadoop文件系统的所有更新操作的路径,文件系统客户端执行的所以写操作首先会被记录到edits文件中。

内存中保存了最新的元数据信息(fsimage和edits)。

edits过大会导致NameNode重启速度慢,Secondary NameNode负责定期合并它们。

合并流程图

数据块的映射关系

1)包括两种:文件与数据块映射关系,DataNode与数据块映射关系;

2)NameNode启动的时候,可通过心跳信息重构映射信息,DataNode运行过程中定时汇报当前block信息;映射关系保存在NameNode内存中。

3)NameNode重启速度慢(需要加载通过合并fsimage与edits文件生成的最新目录树以及DataNode的块信息)

数据块(block)

1)在HDFS中,文件被切分成固定大小的数据块,默认大小为64MB,也可自己配置。

2)为何数据块如此大,因为数据传输时间超过寻道时间(高吞吐率)。

3)文件的存储方式:按大小被切分成若干个block,存储到不同节点上,默认情况下每个block有三个副本。

HDFS的默认副本存放策略

Hadoop 0.17 之后:副本1-同Client的节点上;副本2-不同机架中的节点上;副本3-同第二个副本的机架中的另一个节点上;其他副本:随机挑选。如下图示例:

HDFS可靠性机制

常见错误情况:文件损坏;网络或者机器失效;NameNode挂掉;

文件的完整性:通过CRC32校验,如果有损坏,用其他副本替代损坏文件;

Heartbeat:DataNode定期向NameNode发送eartbeat;

元数据信息:FsImage、Editlog进行多份备份,当NameNode宕机后,可手动还原。

HDFS 数据备份

HDFS被设计成一个可以在大集群中、跨机器、可靠的存储海量数据的框架。它将所有文件存储成block块组成的序列,除了最后一个block块,所有的block块大小都是一样的。文件的所有block块都会因为容错而被复制。每个文件的block块大小和容错复制份数都是可配置的。容错复制份数可以在文件创建时配置,后期也可以修改。HDFS中的文件默认规则是write one(一次写、多次读)的,并且严格要求在任何时候只有一个writer。NameNode负责管理block块的复制,它周期性地接收集群中所有DataNode的心跳数据包和Blockreport。心跳包表示DataNode正常工作,Blockreport描述了该DataNode上所有的block组成的列表。

备份数据的存放:

备份数据的存放是HDFS可靠性和性能的关键。HDFS采用一种称为rack-aware的策略来决定备份数据的存放。通过一个称为Rack Awareness的过程,NameNode决定每个DataNode所属rack id。缺省情况下,一个block块会有三个备份,一个在NameNode指定的DataNode上,一个在指定DataNode非同一rack的DataNode上,一个在指定DataNode同一rack的DataNode上。这种策略综合考虑了同一rack失效、以及不同rack之间数据复制性能问题。

副本的选择:

为了降低整体的带宽消耗和读取延时,HDFS会尽量读取最近的副本。如果在同一个rack上有一个副本,那么就读该副本。如果一个HDFS集群跨越多个数据中心,那么将首先尝试读本地数据中心的副本。

安全模式:

系统启动后先进入安全模式,此时系统中的内容不允许修改和删除,直到安全模式结束。安全模式主要是为了启动检查各个DataNode上数据块的安全性。

HDFS的读写流程

HDFS文件读取:

首先调用FileSystem对象的open方法,其实是一个DistributedFileSystem的实例

DistributedFileSystem通过rpc获得文件的第一批个block的locations,同一block按照重复数会返回多个locations,这些locations按照hadoop拓扑结构排序,距离客户端近的排在前面.

前两步会返回一个FSDataInputStream对象,该对象会被封装成DFSInputStream对象,DFSInputStream可以方便的管理datanode和namenode数据流。客户端调用read方法,DFSInputStream最会找出离客户端最近的datanode并连接。

数据从datanode源源不断的流向客户端。

如果第一块的数据读完了,就会关闭指向第一块的datanode连接,接着读取下一块。这些操作对客户端来说是透明的,客户端的角度看来只是读一个持续不断的流。

如果第一批block都读完了,DFSInputStream就会去namenode拿下一批blocks的location,然后继续读,如果所有的块都读完,这时就会关闭掉所有的流。

HDFS读取发生异常处理

如果在读数据的时候,DFSInputStream和datanode的通讯发生异常,就会尝试正在读的block的排第二近的datanode,并且会记录哪个datanode发生错误,剩余的blocks读的时候就会直接跳过该datanode。DFSInputStream也会检查block数据校验和,如果发现一个坏的block,就会先报告到namenode节点,然后DFSInputStream在其他的datanode上读该block的镜像

HDFS读操作设计思考

客户端直接连接datanode来检索数据并且namenode来负责为每一个block提供最优的datanode,namenode仅仅处理block location的请求,这些信息都加载在namenode的内存中,hdfs通过datanode集群可以承受大量客户端的并发访问。

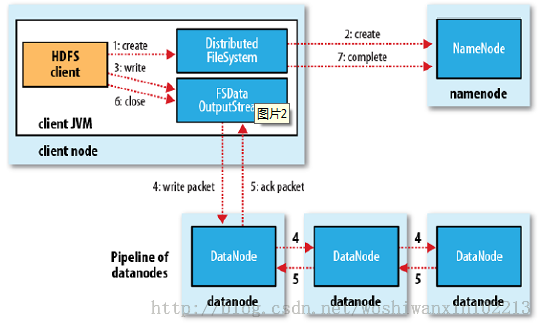

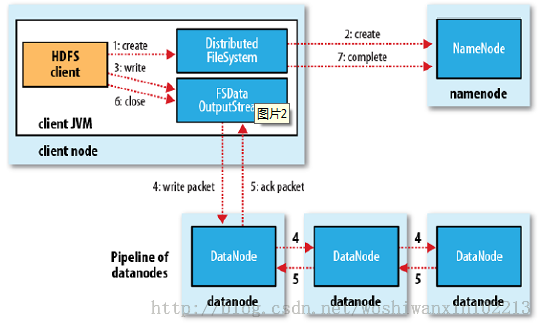

HDFS文件写入

客户端通过调用DistributedFileSystem的create方法创建新文件

DistributedFileSystem通过RPC调用namenode去创建一个没有blocks关联的新文件,创建前,namenode会做各种校验,比如文件是否存在,客户端有无权限去创建等。如果校验通过,namenode就会记录下新文件,否则就会抛出IO异常.

前两步结束后会返回FSDataOutputStream的对象,和读文件的时候相似,FSDataOutputStream被封装成DFSOutputStream,DFSOutputStream可以协调namenode和datanode。客户端开始写数据到DFSOutputStream,DFSOutputStream会把数据切成一个个小packet,然后排成队列data quene。

DataStreamer会去处理接受data quene,他先问询namenode这个新的block最适合存储的在哪几个datanode里,比如重复数是3,那么就找到3个最适合的datanode,把他们排成一个pipeline.DataStreamer把packet按队列输出到管道的第一个datanode中,第一个datanode又把packet输出到第二个datanode中,以此类推。

DFSOutputStream还有一个对列叫ack quene,也是有packet组成,等待datanode的收到响应,当pipeline中的所有datanode都表示已经收到的时候,这时akc quene才会把对应的packet包移除掉。

客户端完成写数据后调用close方法关闭写入流

DataStreamer把剩余得包都刷到pipeline里然后等待ack信息,收到最后一个ack后,通知datanode把文件标示为已完成。

HDFS文件写入失败

如果在写的过程中某个datanode发生错误,会采取以下几步:

1.pipeline被关闭

2.为了防止防止丢包ack quene里的packet会同步到data quene

3.把产生错误的datanode上当前在写但未完成的block删

4.block剩下的部分被写到剩下的两个正常的datanode

5.namenode找到另外的datanode去创建这个块的复

这些操作对客户端来说是无感知的。

(客户端执行write操作后,写完得block才是可见的,正在写的block对客户端是不可见的,只有调用sync方法,客户端才确保该文件被写操作已经全部完成,当客户端调用close方法时会默认调用sync方法。是否需要手动调用取决你根据程序需要在数据健壮性和吞吐率之间的权衡。)

hadoop架构组成

hadoop有两部分组成:分布式文件系统HDFS,统一的资源管理器YARN

hdfs架构

Client:切分文件;访问或通过命令行管理HDFS;与NameNode交互,获取文件位置信息;与DataNode交互,读取和写入数据。

NameNode:Master节点,只有一个,管理HDFS的名称空间和数据块映射信息;配置副本策略;处理客户端请求。

DataNode:Slave节点,存储实际的数据;执行数据块的读写;汇报存储信息给NameNode。

Secondary NameNode:辅助NameNode,分担其工作量;定期合并fsimage和fsedits,推送给NameNode;紧急情况下,可辅助恢复NameNode,但Secondary NameNode并非NameNode的热备。

fsimage和fsedits

NameNode中两个很重要的文件,

fsimage是元数据镜像文件(保存文件系统的目录树)。

edits是元数据操作日志(记录每次保存fsimage之后到下次保存之间的所有hdfs操作)。

fsimage文件其实是Hadoop文件系统元数据的一个永久性的检查点,其中包含Hadoop文件系统中的所有目录和文件idnode的序列化信息;

edits文件存放的是Hadoop文件系统的所有更新操作的路径,文件系统客户端执行的所以写操作首先会被记录到edits文件中。

内存中保存了最新的元数据信息(fsimage和edits)。

edits过大会导致NameNode重启速度慢,Secondary NameNode负责定期合并它们。

合并流程图

数据块的映射关系

1)包括两种:文件与数据块映射关系,DataNode与数据块映射关系;

2)NameNode启动的时候,可通过心跳信息重构映射信息,DataNode运行过程中定时汇报当前block信息;映射关系保存在NameNode内存中。

3)NameNode重启速度慢(需要加载通过合并fsimage与edits文件生成的最新目录树以及DataNode的块信息)

数据块(block)

1)在HDFS中,文件被切分成固定大小的数据块,默认大小为64MB,也可自己配置。

2)为何数据块如此大,因为数据传输时间超过寻道时间(高吞吐率)。

3)文件的存储方式:按大小被切分成若干个block,存储到不同节点上,默认情况下每个block有三个副本。

HDFS的默认副本存放策略

Hadoop 0.17 之后:副本1-同Client的节点上;副本2-不同机架中的节点上;副本3-同第二个副本的机架中的另一个节点上;其他副本:随机挑选。如下图示例:

HDFS可靠性机制

常见错误情况:文件损坏;网络或者机器失效;NameNode挂掉;

文件的完整性:通过CRC32校验,如果有损坏,用其他副本替代损坏文件;

Heartbeat:DataNode定期向NameNode发送eartbeat;

元数据信息:FsImage、Editlog进行多份备份,当NameNode宕机后,可手动还原。

HDFS 数据备份

HDFS被设计成一个可以在大集群中、跨机器、可靠的存储海量数据的框架。它将所有文件存储成block块组成的序列,除了最后一个block块,所有的block块大小都是一样的。文件的所有block块都会因为容错而被复制。每个文件的block块大小和容错复制份数都是可配置的。容错复制份数可以在文件创建时配置,后期也可以修改。HDFS中的文件默认规则是write one(一次写、多次读)的,并且严格要求在任何时候只有一个writer。NameNode负责管理block块的复制,它周期性地接收集群中所有DataNode的心跳数据包和Blockreport。心跳包表示DataNode正常工作,Blockreport描述了该DataNode上所有的block组成的列表。

备份数据的存放:

备份数据的存放是HDFS可靠性和性能的关键。HDFS采用一种称为rack-aware的策略来决定备份数据的存放。通过一个称为Rack Awareness的过程,NameNode决定每个DataNode所属rack id。缺省情况下,一个block块会有三个备份,一个在NameNode指定的DataNode上,一个在指定DataNode非同一rack的DataNode上,一个在指定DataNode同一rack的DataNode上。这种策略综合考虑了同一rack失效、以及不同rack之间数据复制性能问题。

副本的选择:

为了降低整体的带宽消耗和读取延时,HDFS会尽量读取最近的副本。如果在同一个rack上有一个副本,那么就读该副本。如果一个HDFS集群跨越多个数据中心,那么将首先尝试读本地数据中心的副本。

安全模式:

系统启动后先进入安全模式,此时系统中的内容不允许修改和删除,直到安全模式结束。安全模式主要是为了启动检查各个DataNode上数据块的安全性。

HDFS的读写流程

HDFS文件读取:

首先调用FileSystem对象的open方法,其实是一个DistributedFileSystem的实例

DistributedFileSystem通过rpc获得文件的第一批个block的locations,同一block按照重复数会返回多个locations,这些locations按照hadoop拓扑结构排序,距离客户端近的排在前面.

前两步会返回一个FSDataInputStream对象,该对象会被封装成DFSInputStream对象,DFSInputStream可以方便的管理datanode和namenode数据流。客户端调用read方法,DFSInputStream最会找出离客户端最近的datanode并连接。

数据从datanode源源不断的流向客户端。

如果第一块的数据读完了,就会关闭指向第一块的datanode连接,接着读取下一块。这些操作对客户端来说是透明的,客户端的角度看来只是读一个持续不断的流。

如果第一批block都读完了,DFSInputStream就会去namenode拿下一批blocks的location,然后继续读,如果所有的块都读完,这时就会关闭掉所有的流。

package test;

import java.io.IOException;

import java.net.URI;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FSDataOutputStream;;

public class Test {

public void WriteFile(String hdfs) throws IOException {

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create(hdfs),conf);

FSDataOutputStream hdfsOutStream = fs.create(new Path(hdfs));

hdfsOutStream.writeChars("hello");

hdfsOutStream.close();

fs.close();

}

public void ReadFile(String hdfs) throws IOException {

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create(hdfs),conf);

FSDataInputStream hdfsInStream = fs.open(new Path(hdfs));

byte[] ioBuffer = new byte[1024];

int readLen = hdfsInStream.read(ioBuffer);

while(readLen!=-1)

{

System.out.write(ioBuffer, 0, readLen);

readLen = hdfsInStream.read(ioBuffer);

}

hdfsInStream.close();

fs.close();

}

public static void main(String[] args) throws IOException {

String hdfs = "hdfs://192.168.56.112:9000/test/hello.txt";

Test t = new Test();

t.WriteFile(hdfs);

t.ReadFile(hdfs);

}

}HDFS读取发生异常处理

如果在读数据的时候,DFSInputStream和datanode的通讯发生异常,就会尝试正在读的block的排第二近的datanode,并且会记录哪个datanode发生错误,剩余的blocks读的时候就会直接跳过该datanode。DFSInputStream也会检查block数据校验和,如果发现一个坏的block,就会先报告到namenode节点,然后DFSInputStream在其他的datanode上读该block的镜像

HDFS读操作设计思考

客户端直接连接datanode来检索数据并且namenode来负责为每一个block提供最优的datanode,namenode仅仅处理block location的请求,这些信息都加载在namenode的内存中,hdfs通过datanode集群可以承受大量客户端的并发访问。

HDFS文件写入

客户端通过调用DistributedFileSystem的create方法创建新文件

DistributedFileSystem通过RPC调用namenode去创建一个没有blocks关联的新文件,创建前,namenode会做各种校验,比如文件是否存在,客户端有无权限去创建等。如果校验通过,namenode就会记录下新文件,否则就会抛出IO异常.

前两步结束后会返回FSDataOutputStream的对象,和读文件的时候相似,FSDataOutputStream被封装成DFSOutputStream,DFSOutputStream可以协调namenode和datanode。客户端开始写数据到DFSOutputStream,DFSOutputStream会把数据切成一个个小packet,然后排成队列data quene。

DataStreamer会去处理接受data quene,他先问询namenode这个新的block最适合存储的在哪几个datanode里,比如重复数是3,那么就找到3个最适合的datanode,把他们排成一个pipeline.DataStreamer把packet按队列输出到管道的第一个datanode中,第一个datanode又把packet输出到第二个datanode中,以此类推。

DFSOutputStream还有一个对列叫ack quene,也是有packet组成,等待datanode的收到响应,当pipeline中的所有datanode都表示已经收到的时候,这时akc quene才会把对应的packet包移除掉。

客户端完成写数据后调用close方法关闭写入流

DataStreamer把剩余得包都刷到pipeline里然后等待ack信息,收到最后一个ack后,通知datanode把文件标示为已完成。

HDFS文件写入失败

如果在写的过程中某个datanode发生错误,会采取以下几步:

1.pipeline被关闭

2.为了防止防止丢包ack quene里的packet会同步到data quene

3.把产生错误的datanode上当前在写但未完成的block删

4.block剩下的部分被写到剩下的两个正常的datanode

5.namenode找到另外的datanode去创建这个块的复

这些操作对客户端来说是无感知的。

(客户端执行write操作后,写完得block才是可见的,正在写的block对客户端是不可见的,只有调用sync方法,客户端才确保该文件被写操作已经全部完成,当客户端调用close方法时会默认调用sync方法。是否需要手动调用取决你根据程序需要在数据健壮性和吞吐率之间的权衡。)

相关文章推荐

- hadoop架构详解二

- MapReduce架构

- 大型网站核心架构要素 之一(总览篇)

- discuz x3.2修改浏览器头部小图标,使网站看起来更专业

- MediaWiki安装及Wiki网站搭建

- opencv 中文网站

- iis提示:无法显示网页 目前访问网站的用户过多

- 面向对象OO 设计、架构终极理解, 以及如何学习一个领域

- 20160328servlet学习笔记网站代码结构分析MVC结构

- 《fullPage.js》创建全屏滚动的网站

- Spark架构

- Dubbo高级篇_01_消息中间件在分布式架构的作用和介绍

- 搭建django网站,局域网内其他主机无法访问问题

- 浅谈SEO翻倍提升网站流量

- 收集的安全网站【公司】

- 百度插件uaredirect.js电脑版跳转到手机版网站

- 每个架构师都应该研究下康威定律

- 快速熟悉Django架构

- 滴滴出行iOS客户端架构演进之路