网 卡 和 IP 的 应 用

2015-10-11 19:50

465 查看

今天不经意间了解到了一块网卡可以绑定多个IP的设置,然后想去看看别人关于这类的文档,又发现了网卡绑定的应用与设置,和一些详细的一卡多IP的配置,在这总结一下;

===================一块网卡绑定多个IP=======================

有的时候我们确实有这样的需求,因为我是个新手遇到的不多嘛,我遇到的是在做高可用的主备集群时,因为要设置一个流动(虚拟)IP,所以在原有网卡上配置了个虚拟IP;

网卡eth0:192.168.1.103 netmask:255.255.255.0

临时配置

ifconfig eth0:0 192.168.0.1 netmask 255.255.255.0 up

ifconfig eth0:1 192.168.0.2 netmask 255.255.255.0 up

测试

ping 192.168.0.1

ping 192.168.0.2

将eth0改为eth0:x(x=0-255),eth0:x称为虚拟网络接口,是建立在网络接口(eth0)上边;

临时配置的IP重启后就会消失。

永久配置

法一:将上述命令加入到开机自动执行的/etc/rc.d/rc/local脚本中去;

法二:给虚拟网卡写一个配置文件

cd /etc/sysconfig/network-scripts/

cp ifcfg-eth0 ifcfg-eth0\:0 \ 脱义符

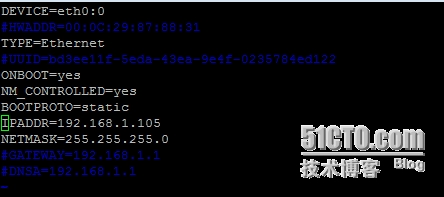

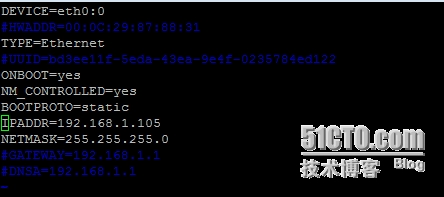

vim ifcfg-eth0:0 将ifcfg-eth0内容拷贝过去,更改如下

只需要更改DEVICE 和 IPADDR即可,别的无所谓

只要设备名字和IP不一样,可以增加255个这样的IP,但会没有必要,配置方法一样;

===================================多网卡绑定[/b]=====================================

Linux下双网卡绑定技术实现负载均衡和失效保护,既增加了服务器的可靠性,又增加了可用网络带宽,为用户提供不间断的关键服务。

双网卡绑定实现就是使用两块网卡虚拟成为一块网卡;

其实这项技术在Sun和Cisco中早已存在,被称为Trunking和Etherchannel技术,在Linux的2.4.x的内核中也采用这这种技术,被称为bonding。

在正常情况下,网卡只接收目的硬件地址(MAC Address)是自身Mac的以太网帧,对于别的数据帧都滤掉,以减轻驱动程序的负担。但是网卡也支持另外一种被称为混杂promisc的模式,可以接收网络上所有的帧,比如说tcpdump,就是运行在这个模式下。

bonding也运行在这个模式下,而且修改了驱动程序中的mac地址,将两块网卡的Mac地址改成相同,可以接收特定mac的数据帧。然后把相应的数据帧传送给bond驱动程序处理。

绑定的条件:芯片组型号相同,而且网卡应该具备自己独立的BIOS芯片

编辑虚拟网络接口配置文件,指定网卡IP

cd /etc/sysconfig/network-scripts/

cp ifcfg-eth0 ifcfg-bond0

vim ifcfg-bond0 将第一行改成 DEVICE=bond0

配置启动加载模块

vi /etc/modules.conf

添加:

alias bond0 bonding

options bond0 miimon=100 mode=1

miimon是用来进行链路监测的。 比如:miimon=100,那么系统每100ms监测一次链路连接状态,如果有一条线路不通就转入另一条线路;mode的值表示工作模式,他共有0,1,2,3四种模式,常用的为0,1两种。

mode=0表示load balancing (round-robin)为负载均衡方式,两块网卡都工作。

mode=1表示fault-tolerance (active-backup)提供冗余功能,工作方式是主备的工作方式,也就是说

默认情况下只有一块网卡工作,另一块做备份.

bonding只能提供链路监测,即从主机到交换机的链路是否接通。如果只是交换机对外的链路down掉了,而交换机本身并没有故障,那么bonding会认为链路没有问题而继续使用

配置开机执行脚本

vi /etc/rc.d/rc.local 添加

重启:看见以下信息就表示配置成功了

................

Bringing up interface bond0 OK

Bringing up interface eth0 OK

Bringing up interface eth1 OK

mode=1工作在主备模式下,当一个网络接口失效时,不会出现网络中断,系统会按照cat /etc/rc.d/rc.local里指定网卡的顺序工作,机器仍能对外服务,起到了失效保护的功能。

ifconfig 验证网卡的配置信息

在mode=0 负载均衡工作模式,他能提供两倍的带宽,在这种情况下出现一块网卡失效,仅仅会是服务器出口带宽下降,也不会影响网络使用。

ifconfig

[root@rhas-13 bonding]# cat /proc/net/bonding/bond0

两个地方不是很清楚:

第一 route add -net 172.31.3.254 netmask 255.255.255.0 bond0 ?

第二 对bond0 eth0 eth1 都配置为dhcp动态获取么?

我的理解是三个网卡都配置为dhcp,配置静态路由的IP是指向三个网卡的,但问题是下面ifconfig得到的

IP,却是172.31.0.13,为什么?

===================一块网卡绑定多个IP=======================

有的时候我们确实有这样的需求,因为我是个新手遇到的不多嘛,我遇到的是在做高可用的主备集群时,因为要设置一个流动(虚拟)IP,所以在原有网卡上配置了个虚拟IP;

网卡eth0:192.168.1.103 netmask:255.255.255.0

临时配置

ifconfig eth0:0 192.168.0.1 netmask 255.255.255.0 up

ifconfig eth0:1 192.168.0.2 netmask 255.255.255.0 up

测试

ping 192.168.0.1

ping 192.168.0.2

将eth0改为eth0:x(x=0-255),eth0:x称为虚拟网络接口,是建立在网络接口(eth0)上边;

临时配置的IP重启后就会消失。

永久配置

法一:将上述命令加入到开机自动执行的/etc/rc.d/rc/local脚本中去;

法二:给虚拟网卡写一个配置文件

cd /etc/sysconfig/network-scripts/

cp ifcfg-eth0 ifcfg-eth0\:0 \ 脱义符

vim ifcfg-eth0:0 将ifcfg-eth0内容拷贝过去,更改如下

只需要更改DEVICE 和 IPADDR即可,别的无所谓

只要设备名字和IP不一样,可以增加255个这样的IP,但会没有必要,配置方法一样;

===================================多网卡绑定[/b]=====================================

Linux下双网卡绑定技术实现负载均衡和失效保护,既增加了服务器的可靠性,又增加了可用网络带宽,为用户提供不间断的关键服务。

双网卡绑定实现就是使用两块网卡虚拟成为一块网卡;

其实这项技术在Sun和Cisco中早已存在,被称为Trunking和Etherchannel技术,在Linux的2.4.x的内核中也采用这这种技术,被称为bonding。

在正常情况下,网卡只接收目的硬件地址(MAC Address)是自身Mac的以太网帧,对于别的数据帧都滤掉,以减轻驱动程序的负担。但是网卡也支持另外一种被称为混杂promisc的模式,可以接收网络上所有的帧,比如说tcpdump,就是运行在这个模式下。

bonding也运行在这个模式下,而且修改了驱动程序中的mac地址,将两块网卡的Mac地址改成相同,可以接收特定mac的数据帧。然后把相应的数据帧传送给bond驱动程序处理。

绑定的条件:芯片组型号相同,而且网卡应该具备自己独立的BIOS芯片

编辑虚拟网络接口配置文件,指定网卡IP

cd /etc/sysconfig/network-scripts/

cp ifcfg-eth0 ifcfg-bond0

vim ifcfg-bond0 将第一行改成 DEVICE=bond0

DEVICE=bond0 BOOTPROTO=static IPADDR=172.31.0.13 NETMASK=255.255.252.0 BROADCAST=172.31.3.254 ONBOOT=yes TYPE=Ethernet这里要注意,不要指定单个网卡的IP 地址、子网掩码或网卡 ID,改为dhcp 动态获取IP;

配置启动加载模块

vi /etc/modules.conf

添加:

alias bond0 bonding

options bond0 miimon=100 mode=1

miimon是用来进行链路监测的。 比如:miimon=100,那么系统每100ms监测一次链路连接状态,如果有一条线路不通就转入另一条线路;mode的值表示工作模式,他共有0,1,2,3四种模式,常用的为0,1两种。

mode=0表示load balancing (round-robin)为负载均衡方式,两块网卡都工作。

mode=1表示fault-tolerance (active-backup)提供冗余功能,工作方式是主备的工作方式,也就是说

默认情况下只有一块网卡工作,另一块做备份.

bonding只能提供链路监测,即从主机到交换机的链路是否接通。如果只是交换机对外的链路down掉了,而交换机本身并没有故障,那么bonding会认为链路没有问题而继续使用

配置开机执行脚本

vi /etc/rc.d/rc.local 添加

ifenslave bond0 eth0 eth1 指定工作顺序 route add -net 172.31.3.254 netmask 255.255.255.0 bond0 设置静态路由

重启:看见以下信息就表示配置成功了

................

Bringing up interface bond0 OK

Bringing up interface eth0 OK

Bringing up interface eth1 OK

mode=1工作在主备模式下,当一个网络接口失效时,不会出现网络中断,系统会按照cat /etc/rc.d/rc.local里指定网卡的顺序工作,机器仍能对外服务,起到了失效保护的功能。

ifconfig 验证网卡的配置信息

bond0 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING MASTER MULTICAST MTU:1500 Metric:1 RX packets:18495 errors:0 dropped:0 overruns:0 frame:0 TX packets:480 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:0 RX bytes:1587253 (1.5 Mb) TX bytes:89642 (87.5 Kb) eth0 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING SLAVE MULTICAST MTU:1500 Metric:1 RX packets:9572 errors:0 dropped:0 overruns:0 frame:0 TX packets:480 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:833514 (813.9 Kb) TX bytes:89642 (87.5 Kb) Interrupt:11 eth1 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING NOARP SLAVE MULTICAST MTU:1500 Metric:1 RX packets:8923 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:753739 (736.0 Kb) TX bytes:0 (0.0 b) Interrupt:15

在mode=0 负载均衡工作模式,他能提供两倍的带宽,在这种情况下出现一块网卡失效,仅仅会是服务器出口带宽下降,也不会影响网络使用。

ifconfig

bond0 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING MASTER MULTICAST MTU:1500 Metric:1 RX packets:2817 errors:0 dropped:0 overruns:0 frame:0 TX packets:95 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:0 RX bytes:226957 (221.6 Kb) TX bytes:15266 (14.9 Kb) eth0 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING SLAVE MULTICAST MTU:1500 Metric:1 RX packets:1406 errors:0 dropped:0 overruns:0 frame:0 TX packets:48 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:113967 (111.2 Kb) TX bytes:7268 (7.0 Kb) Interrupt:11 eth1 Link encap:Ethernet HWaddr 00:0E:7F:25:D9:8B inet addr:172.31.0.13 Bcast:172.31.3.255 Mask:255.255.252.0 UP BROADCAST RUNNING SLAVE MULTICAST MTU:1500 Metric:1 RX packets:1411 errors:0 dropped:0 overruns:0 frame:0 TX packets:47 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:112990 (110.3 Kb) TX bytes:7998 (7.8 Kb) Interrupt:15通过查看bond0的工作状态查询能详细的掌握bonding的工作状态

[root@rhas-13 bonding]# cat /proc/net/bonding/bond0

bonding.c:v2.4.1 (September 15, 2003) Bonding Mode: load balancing (round-robin) MII Status: up MII Polling Interval (ms): 0 Up Delay (ms): 0 Down Delay (ms): 0 Multicast Mode: all slaves Slave Interface: eth1 MII Status: up Link Failure Count: 0 Permanent HW addr: 00:0e:7f:25:d9:8a Slave Interface: eth0 MII Status: up Link Failure Count: 0 Permanent HW addr: 00:0e:7f:25:d9:8b

两个地方不是很清楚:

第一 route add -net 172.31.3.254 netmask 255.255.255.0 bond0 ?

第二 对bond0 eth0 eth1 都配置为dhcp动态获取么?

我的理解是三个网卡都配置为dhcp,配置静态路由的IP是指向三个网卡的,但问题是下面ifconfig得到的

IP,却是172.31.0.13,为什么?

相关文章推荐

- Linux socket 初步

- linux lsof详解

- linux 文件权限

- Linux 执行数学运算

- 10 篇对初学者和专家都有用的 Linux 命令教程

- Linux 与 Windows 对UNICODE 的处理方式

- Ubuntu12.04下QQ完美走起啊!走起啊!有木有啊!

- 解決Linux下Android开发真机调试设备不被识别问题

- 运维入门

- 运维提升

- Linux 自检和 SystemTap

- Ubuntu Linux使用体验

- c语言实现hashmap(转载)

- Linux 信号signal处理机制

- linux下mysql添加用户

- Scientific Linux 5.5 图形安装教程

- 基于 Linux 集群环境上 GPFS 的问题诊断

- 谁是桌面王者?Win PK Linux三大镇山之宝

- vivi下重新调整分区