海量数据的二度人脉挖掘算法(Hadoop 实现)

2015-09-10 15:55

323 查看

/article/3478152.html

原创博客,转载请注明:/article/3478152.html

最近做了一个项目,要求找出二度人脉的一些关系,就好似新浪微博的“你可能感兴趣的人” 中,间接关注推荐;简单描述:即你关注的人中有N个人同时都关注了 XXX 。

在程序的实现上,其实我们要找的是:若 User1 follow了10个人 {User3,User4,User5,... ,User12}记为集合UF1,那么 UF1中的这些人,他们也有follow的集合,分别是记为: UF3(User3 follow的人),UF4,UF5,...,UF12;而在这些集合肯定会有交集,而由最多集合求交产生的交集,就是我们要找的:感兴趣的人。

我在网上找了些,关于二度人脉算法的实现,大部分无非是通过广度搜索算法来查找,由于深度已经明确了2以内;这个算法其实很简单,第一步找到你关注的人;第二步找到这些人关注的人,最后找出第二步结果中出现频率最高的一个或多个人,即完成。

但如果有千万级别的用户,那在运算时,就肯定会把这些用户的follow 关系放到内存中,计算的时候依次查找;先说明下我没有明确的诊断对比,这样做的效果不一定就不如 基于hadoop实现的好;只是自己,想用hadoop实现下,最近也在学;若有不足的地方还请指点。

首先,我的初始数据是文件,每一行为一个follow 关系 ida+‘\t’+idb;表示 ida follow idb。其次,用了2个Map/Reduce任务。

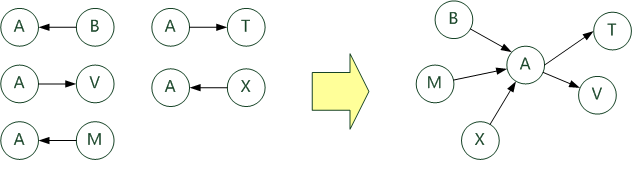

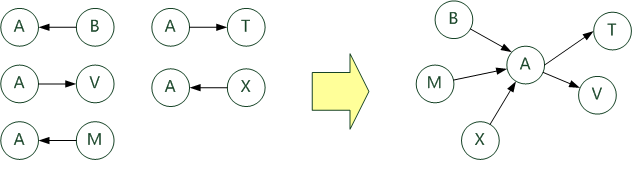

Map/Reduce 1:找出 任意一个用户 的 follow 集合与 被 follow 的集合。如图所示:

代码如下:

Map任务: 输出时 key :间接者 A 的ID ,value:follow 的人的ID 或 被follow的人的ID

?

Reduce任务:

输出时 key

:间接者 A 的ID , value为 两个String,第一个而follow的所有人(用分割符分割),第二个为 被follow的人(同样分割)

?

其中Separator.TABLE_String为自定义的分隔符;TextPair为自定义的

Writable 类,让一个key可以对应两个value,且这两个value可区分。

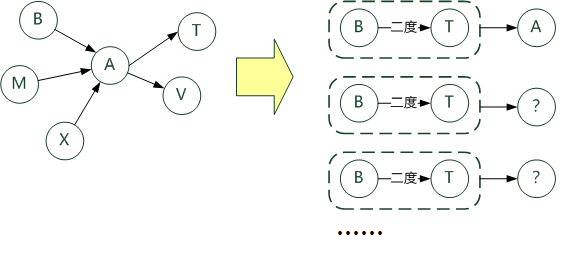

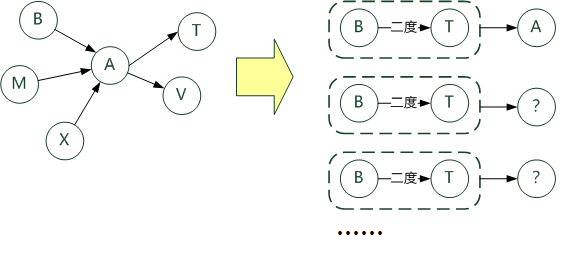

Map/Reduce 2:在上一步关系中,若B follow A,而 A follow T ,则可以得出 T 为 B 的二度人脉,且 间接者为A ,于是找出 相同二度人脉的不同间接人。如图所示:

代码如下:

Map 任务:输出时 key 为 由两个String 记录的ID表示的 二度人脉关系,value 为 这个二度关系产生的间接人的ID

?

Reduce任务:输出时 key 仍然为二度人脉关系, value 为所有间接人 的ID以逗号分割。

?

到这步,二度人脉关系基本已经挖掘出来,后续的处理就很简单了,当然也可以基于二度人脉挖掘三度,四度:)

原创博客,转载请注明:/article/3478152.html

最近做了一个项目,要求找出二度人脉的一些关系,就好似新浪微博的“你可能感兴趣的人” 中,间接关注推荐;简单描述:即你关注的人中有N个人同时都关注了 XXX 。

在程序的实现上,其实我们要找的是:若 User1 follow了10个人 {User3,User4,User5,... ,User12}记为集合UF1,那么 UF1中的这些人,他们也有follow的集合,分别是记为: UF3(User3 follow的人),UF4,UF5,...,UF12;而在这些集合肯定会有交集,而由最多集合求交产生的交集,就是我们要找的:感兴趣的人。

我在网上找了些,关于二度人脉算法的实现,大部分无非是通过广度搜索算法来查找,由于深度已经明确了2以内;这个算法其实很简单,第一步找到你关注的人;第二步找到这些人关注的人,最后找出第二步结果中出现频率最高的一个或多个人,即完成。

但如果有千万级别的用户,那在运算时,就肯定会把这些用户的follow 关系放到内存中,计算的时候依次查找;先说明下我没有明确的诊断对比,这样做的效果不一定就不如 基于hadoop实现的好;只是自己,想用hadoop实现下,最近也在学;若有不足的地方还请指点。

首先,我的初始数据是文件,每一行为一个follow 关系 ida+‘\t’+idb;表示 ida follow idb。其次,用了2个Map/Reduce任务。

Map/Reduce 1:找出 任意一个用户 的 follow 集合与 被 follow 的集合。如图所示:

代码如下:

Map任务: 输出时 key :间接者 A 的ID ,value:follow 的人的ID 或 被follow的人的ID

?

输出时 key

:间接者 A 的ID , value为 两个String,第一个而follow的所有人(用分割符分割),第二个为 被follow的人(同样分割)

?

Writable 类,让一个key可以对应两个value,且这两个value可区分。

Map/Reduce 2:在上一步关系中,若B follow A,而 A follow T ,则可以得出 T 为 B 的二度人脉,且 间接者为A ,于是找出 相同二度人脉的不同间接人。如图所示:

代码如下:

Map 任务:输出时 key 为 由两个String 记录的ID表示的 二度人脉关系,value 为 这个二度关系产生的间接人的ID

?

?

相关文章推荐

- xshell命令大全

- 同时新建AD账号、邮箱、添加通讯组的powershell脚本

- org.apache.hadoop.hbase.mapreduce.Driver 导入数据到HBASE table

- 发现apache的mod_python存在一个BUG

- 基于hadoop的推荐算法-mahout版

- Hadoop

- CentOS 安装java环境

- hadoop “util.NativeCodeLoader: Unable to load native-hadoop library for your platform”

- win7+tomcat+jenkins 环境部署

- Linux下解压zip乱码问题的解决(unzip)

- CentOS下搭建DNS服务器-2

- CentOS下搭建DNS服务器-1

- Linux命令行修改IP、网关、DNS的方法

- 2015年移动设备界面设计趋势

- linux 下安装字体

- linux下socket编程实例

- Actor Platform 平台搭建(一) -平台介绍-Docker搭建方法

- 依赖注入及AOP简述(三)——依赖注入的原理

- 15种最佳方式帮你顺利掌握Hadoop技术

- Linux-LVS+keepalived-Testing