Spark + Hadoop-2.2.0 伪分布环境下的环境搭建

2015-06-07 19:12

351 查看

上一次我介绍了,没有hadoop模式下的spark的安装,下面将要介绍基于hadoop伪分布模式下的spark环境的搭建,其中hadoop为hadoop-2.2.0的环境,系统为ubuntu-14.04

1.首先要确保spark已经成功解压安装,详情请查看上篇博文

http://blog.csdn.net/qiumianderen5/article/details/46400885

2.然后修改spark目录下conf里面的spark-env.sh 文件

(1)首先需要从 spark-env.sh.template 中创建一个新的spark-env.sh文件

(2)然后修改spark-env.sh里面的参数

修改的内容:

3.然后启动spark:

4.如果需要启动HDFS或者YARN则需要转到hadoop中去启动相应的HDFS和YARN

启动HDFS:

启动YARN:

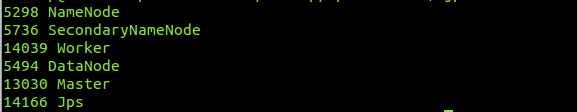

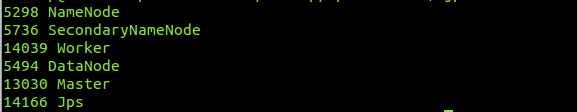

5.效果

其中的Master和Worker就是Spark的启动的进程

希望大家都能搭建成功

1.首先要确保spark已经成功解压安装,详情请查看上篇博文

http://blog.csdn.net/qiumianderen5/article/details/46400885

2.然后修改spark目录下conf里面的spark-env.sh 文件

(1)首先需要从 spark-env.sh.template 中创建一个新的spark-env.sh文件

cp spark-env.sh.template spark-env.sh

(2)然后修改spark-env.sh里面的参数

vim spark-env.sh

修改的内容:

export SCALA_HOME=/usr/local/share/scala/scala-2.10.4 export JAVA_HOME=/usr/jdk1.7.0_51 export SPARK_MASTER=localhost export SPARK_LOCAL_IP=localhost export HADOOP_HOME=/home/hadoop/hadoop/hadoop-2.2.0 export SPARK_HOME=/home/hadoop/hadoop/spark-1.3.1 export SPARK_LIBARY_PATH=.:$JAVA_HOME/lib:$JAVA_HOME/jre/lib:$HADOOP_HOME/lib/native export YARN_CONF_DIR=$HADOOP_HOME/etc/hadoop export SPARK_EXAMPLE_JAR=/home/hadoop/hadoop/spark-1.3.1/examples/target/spark-examples_2.10-1.3.1.jar

3.然后启动spark:

sbin/start-all.sh

4.如果需要启动HDFS或者YARN则需要转到hadoop中去启动相应的HDFS和YARN

启动HDFS:

start-dfs.sh

启动YARN:

start-yarn.sh

5.效果

其中的Master和Worker就是Spark的启动的进程

希望大家都能搭建成功

相关文章推荐

- 详解HDFS Short Circuit Local Reads

- Hadoop_2.1.0 MapReduce序列图

- 使用Hadoop搭建现代电信企业架构

- [原创]java局域网聊天系统

- Spark随谈——开发指南(译)

- 单机版搭建Hadoop环境图文教程详解

- Spark,一种快速数据分析替代方案

- Windows 系统组策略应用全攻略(下)第1/3页

- 如何进行系统配置

- C#列出当前系统所有正在运行程序的方法

- SqlServer系统数据库的作用深入了解

- Powershell获取系统中所有可停止的服务

- 不用杀毒软件也能让系统百毒不侵的技巧

- Android操作系统的架构设计分析

- 文章推荐系统(二)

- PHP网上调查系统

- hadoop常见错误以及处理方法详解

- Shell脚本实现Linux系统和进程资源监控

- 文章推荐系统(三)

- sqlserver 系统存储过程 中文说明