Support Vector Machines for Multiple-Instance Learning

2015-05-24 10:18

253 查看

引用次数700+

文章中利用SVM解决multiple-instance learning问题,提出了mi-SVM及MI-SVM算法。

1、什么是multiple-instance learning?

Multiple-instance learning (MIL) is a variation on supervised learning. Instead of receiving a set of instances which are individually labeled, the learner receives a set of labeled bags, each containing many instances. In the simple case of multiple-instance binary classification, a bag may be labeled negative if all the instances in it are negative. On the other hand, a bag is labeled positive if there is at least one instance in it which is positive. From a collection of labeled bags, the learner tries to either (i) induce a concept that will label individual instances correctly or (ii) learn how to label bags without inducing the concept(来自Wiki)

数学描述:

假设我们有一些图像样本,图像中含有人的图片为正样本,不含有人的为负样本。整个图像就可以视为一个bag,假设我们有m个图像,用 B1,B2,...,Bm 代表这些图像,用 YI 表示 BI 的正负。在这些图像中,我们利用滑动的矩形窗切取小的图像,从而可以得到n个pattern xi ,那么 BI={xi:iϵI} ,其中 I⊑{1,2,...,n},用 yi 表示这些pattern的标签(正或负),那么pattern的标签 yi 和bag YI 的标签具有的关系可以描述为:⎧⎩⎨yi=−1,iεI,s.t.YI=−1∑yi+12>=1,iεI,s.t.YI=1 即正的Bag中至少有一个patter为正,负的Bag里面所有都为负。有人的图像中至少有一个矩形窗口中是有人的,没有人的图像中所有矩形窗口的图像都没有人。我们的目的就是要训练一个分类器可以把这些图像bag或者将这些pattern分类。文章中利用mi-SVM和MI-SVM解决这个问题,mi-SVM适合于分类pattern,而MI-SVM适合于分类bag。

2、mi-SVM

Treats the pattern labels as unobserved integer variables,subjected to constraints defined by the bags labels. The goal then is to maximize the usual pattern margin, or soft-margin, jointly over hidden labels variables and a linear(or kernelized) discriminant function.

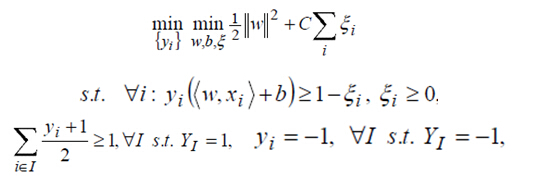

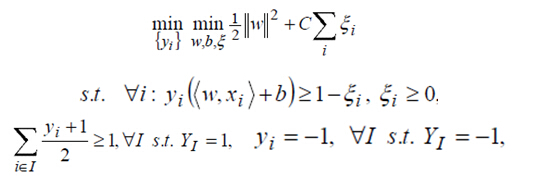

目标函数为:

与传统的SVM区别的是这里对 yi 做了minimize。通过最优化这个目标函数,实现了对pattern的分类,从而可以对bag分类。

3、MI-SVM

The MI-SVM aims at maximizing the bag margin directly.

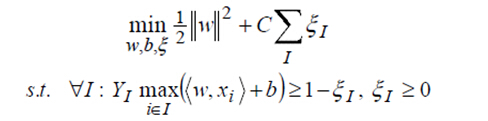

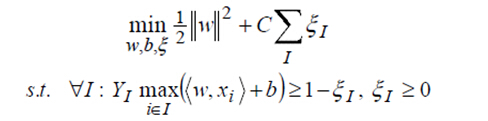

目标函数为:

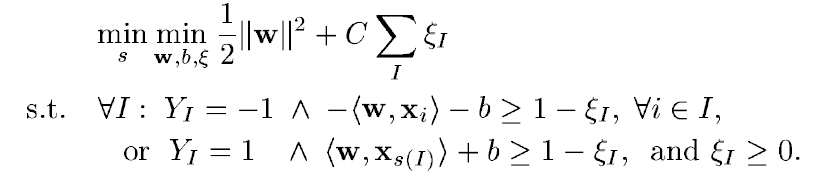

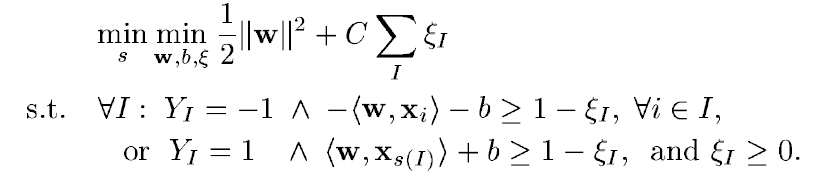

在正的bag中(YI=1),用 xs(I),s(I)εI 表示正的pattern,因此目标函数可以写为:

在目标函数的最优化中,正的bag中负pattern对目标函数的最优化没有贡献。此外,在解决这个目标函数的对偶问题时,拉格朗日乘子跟标准的SVM有所不同。{0≤aI≤C,s.t.YI=10≤∑ai≤C,s.t.YI=−1

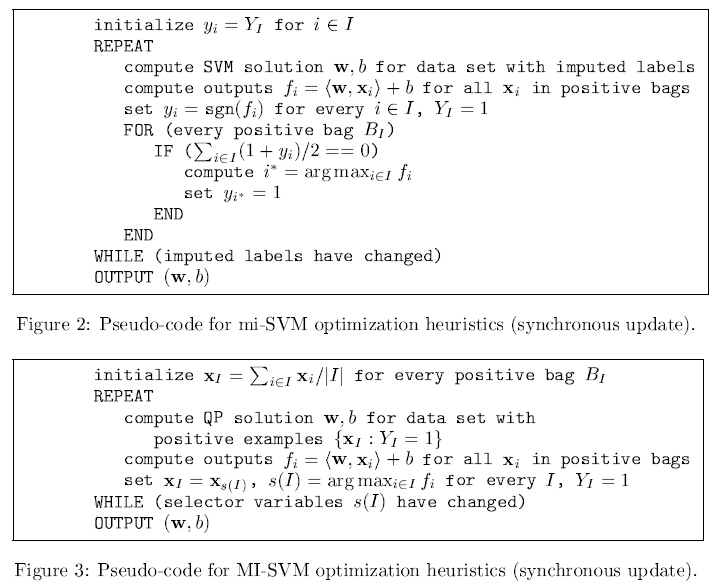

4、mi-SVM及MI-SVM目标函数最优化

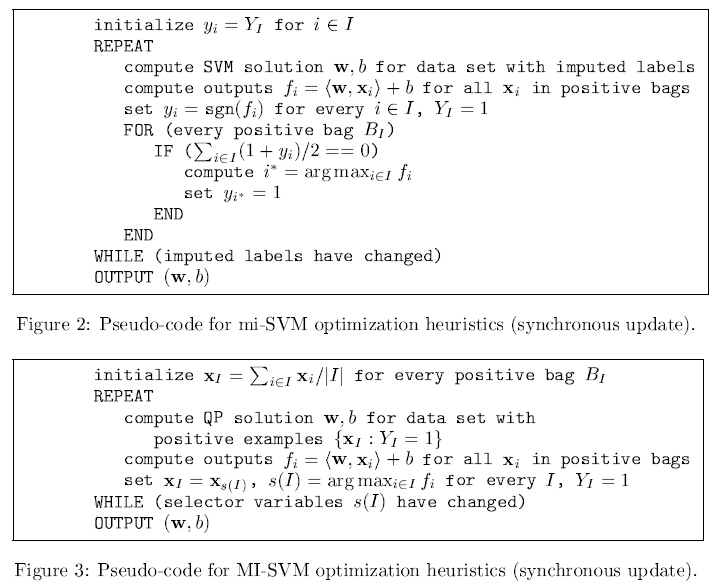

与传统的SVM相比,在mi-SVM中需要对隐变量yi最优化。在MI-SVM中需要对变量s(I)最优化。这类最优化的问题可以分两步进行。首先给定一个yi或者s(I),解一个标准的SVM问题。其次,利用上一步得到的SVM参数,最优化yi或者s(I),逐渐迭代至最优。

伪代码如下:

文章中利用SVM解决multiple-instance learning问题,提出了mi-SVM及MI-SVM算法。

1、什么是multiple-instance learning?

Multiple-instance learning (MIL) is a variation on supervised learning. Instead of receiving a set of instances which are individually labeled, the learner receives a set of labeled bags, each containing many instances. In the simple case of multiple-instance binary classification, a bag may be labeled negative if all the instances in it are negative. On the other hand, a bag is labeled positive if there is at least one instance in it which is positive. From a collection of labeled bags, the learner tries to either (i) induce a concept that will label individual instances correctly or (ii) learn how to label bags without inducing the concept(来自Wiki)

数学描述:

假设我们有一些图像样本,图像中含有人的图片为正样本,不含有人的为负样本。整个图像就可以视为一个bag,假设我们有m个图像,用 B1,B2,...,Bm 代表这些图像,用 YI 表示 BI 的正负。在这些图像中,我们利用滑动的矩形窗切取小的图像,从而可以得到n个pattern xi ,那么 BI={xi:iϵI} ,其中 I⊑{1,2,...,n},用 yi 表示这些pattern的标签(正或负),那么pattern的标签 yi 和bag YI 的标签具有的关系可以描述为:⎧⎩⎨yi=−1,iεI,s.t.YI=−1∑yi+12>=1,iεI,s.t.YI=1 即正的Bag中至少有一个patter为正,负的Bag里面所有都为负。有人的图像中至少有一个矩形窗口中是有人的,没有人的图像中所有矩形窗口的图像都没有人。我们的目的就是要训练一个分类器可以把这些图像bag或者将这些pattern分类。文章中利用mi-SVM和MI-SVM解决这个问题,mi-SVM适合于分类pattern,而MI-SVM适合于分类bag。

2、mi-SVM

Treats the pattern labels as unobserved integer variables,subjected to constraints defined by the bags labels. The goal then is to maximize the usual pattern margin, or soft-margin, jointly over hidden labels variables and a linear(or kernelized) discriminant function.

目标函数为:

与传统的SVM区别的是这里对 yi 做了minimize。通过最优化这个目标函数,实现了对pattern的分类,从而可以对bag分类。

3、MI-SVM

The MI-SVM aims at maximizing the bag margin directly.

目标函数为:

在正的bag中(YI=1),用 xs(I),s(I)εI 表示正的pattern,因此目标函数可以写为:

在目标函数的最优化中,正的bag中负pattern对目标函数的最优化没有贡献。此外,在解决这个目标函数的对偶问题时,拉格朗日乘子跟标准的SVM有所不同。{0≤aI≤C,s.t.YI=10≤∑ai≤C,s.t.YI=−1

4、mi-SVM及MI-SVM目标函数最优化

与传统的SVM相比,在mi-SVM中需要对隐变量yi最优化。在MI-SVM中需要对变量s(I)最优化。这类最优化的问题可以分两步进行。首先给定一个yi或者s(I),解一个标准的SVM问题。其次,利用上一步得到的SVM参数,最优化yi或者s(I),逐渐迭代至最优。

伪代码如下:

相关文章推荐

- Support Vector Machines for Non-Linearly Separable Data

- Support Vector Machines for classification

- Is it OK to mix categorical and continuous data for SVM (Support Vector Machines)?

- 理解LIBSVM: A Library for Support Vector Machines

- Support Vector Machines for Non-Linearly Separable Data

- Study notes for Support Vector Machines (2)

- Asymptotic Behaviors of Support Vector Machines with Gaussian Kernel的几个结论

- 数据挖掘十大经典算法(3) Support vector machines

- 海量数据挖掘MMDS week6: 支持向量机Support-Vector Machines,SVM

- 转载 数据挖掘十大经典算法(3) Support vector machines

- PatentTips - Method for network interface sharing among multiple virtual machines

- 支持向量机SVM(Support Vector Machines)介绍

- 支持向量机 Support Vector Machines

- 支持向量机support vector machines

- Coursera Machine Learning 第七周 quiz Support Vector Machines

- python中sklearn的支持向量机(Support Vector Machines)的说明地址

- 数据挖掘十大经典算法(3) Support vector machines

- Asymptotic Behaviors of Support Vector Machines with Gaussian Kernel的几个结论

- 【Coursera】Machine learning - week7 : Support Vector Machines

- PRML读书会第七章 Sparse Kernel Machines(支持向量机, support vector machine ,KKT条件,RVM)